1. 서 론

2. 연구지역 및 재료

2.1 연구지역

2.2 연구재료

3. 연구방법

3.1 학습자료 및 검증 데이터 구축

3.2 Attention U-Net

3.3 모형학습의 성능 평가

3.4 옥수수 재배 필지 추출 및 모형 성능평가

4. 연구 결과 및 분석

4.1 데이터 셋 구축 결과

4.2 모형 학습 결과에 대한 평가

4.3 모형 성능평가

5. 결 론

1. 서 론

최근 농림축산식품부는 구조적인 쌀 공급과잉 문제를 해소하고, 식량자급률 향상을 위한 ‘논 타작물 재배 지원 사업’을 추진하고 있다. 우리나라는 2019년 기준 식량자급률이 45.8%로 OECD 국가 중 최하위 수준이다 (MAFRA 2021). 이중 국내 쌀 자급률은 92.1%로 매우 높은 수준이지만, 옥수수 및 콩 등 주요 식량 작물은 각각 3.5%, 26.7%로 매우 낮은 실정이다 (MAFRA 2021). 그러나 이 사업은 전국적으로 시행하고 있으나, 중앙정부나 각 지자체는 작물 재배 현황 파악에 어려움을 겪고 있다. 작물 재배 현황 파악은 현장조사 및 전수조사를 통해 이루어지며 막대한 예산 및 인력이 소요된다. 재배 현황은 토지이용 급변 등으로 단시간 내 파악이 물리적으로 매우 어렵다. 특히, 충북 괴산군은 유기농산물 진흥을 위해 재배필지에 대한 현황파악이 매우 시급한 실정이다. 괴산군은 2018년에 국립식량과학원이 개발한 옥수수 품종에 대한 기술이전을 받았다. 이에 따라 괴산군은 옥수수 재배면적을 2021년 40 ha에서 2025년까지 500 ha로 확대할 계획이다 (NICS, 2021).

위성 및 무인기 (Unmanned Aerial Vehicle, UAV) 기반 원격탐사 (Remote Sensing) 기법은 재배 필지 현황 파악을 위한 지자체의 유용한 대안이 될 수 있다. 위성영상을 이용한 원격탐사는 조사지점 특성에 따라 환경, 해양, 토지이용 등과 같이 사람이 직접 전수조사를 하기에 어려운 공간에 대한 특성 분석을 할 수 있는 장점이 있어 활발히 활용되고 있다. 또한, 위성영상은 농업 분야에서도 다양하게 활용되고 있다. Na et al. (2017)는 Landsat-8 위성영상을 사용하여 동계 작물의 재배면적과 공간분포를 파악하고 계층분류 기반의 시군단위 동계작물 구분도를 작성한 바 있다. 5은 Landsat-8 및 Sentinel-1A 위성영상을 딥러닝 모형인 앙상블 CNN모형에 적용하여 밀, 해바라기, 콩 및 사탕수수 재배지역에 대한 분류 연구를 실시하였다. Seong et al. (2020)은 RapidEye 위성영상을 활용하여 딥러닝 모형인 FC-DenseNet에 적용할 훈련자료를 구축하였고, 지적도와 결합하여 작물 재배면적을 추정하였다. 특히, 위성영상 기반 원격탐사는 재배필지에 대한 면적 추출과 작황 예측 기초자료로 활용하는데 유용하다고 보고되고 있다 (Kim et al. 2014, McNairn et al. 2014).

위성영상 활용은 광지역에 대한 공간정보를 취득할 수 있다는 장점과 연구자가 다양한 분야에 활용 가능하다는 이점을 갖고 있다. 그러나 단점은 기상 조건에 따라 영상자료 수집 및 활용에 제한을 받는다는 점이다. 특히, 한국은 옥수수가 재배되는 시기인 7월부터 9월까지 연중 강수량의 2/3가 집중되어 장마, 집중호우 등이 나타난다. 이 시기는 기상조건이 매우 불안정한 시기로 위성영상 활용에 운량 (cloud cover) 등의 문제로 영상 취득에 한계가 있다. KOMPSAT (Korea multi-purpose satellite) 영상은 10년 동안 강우가 집중되는 6월부터 9월까지 활용 가능한 무운량 (non-cloud cover) 영상 자료가 1 - 2장에 불과한 실정이다 (Park and Park 2015).

무인기는 위성영상의 약점을 대체할 수 있는 유용한 방법 중 하나이다. 농업모니터링 분야에서 무인기는 대상지역에 쉽게 접근하여 주기적으로 촬영할 수 있어서 활용성이 매우 높다 (Park and Park 2015). 최근 무인기 기반 원격탐사 기술은 매우 빠르게 발전하고 있으며, 농업분야에서 다양하게 활용되면서 관련 연구도 크게 증가하고 있다 (Lee et al. 2020, Jeong et al. 2021). 이와 관련하여 Park and Park (2015, 2016)은 농업 직불제 이행점검 업무에 무인기 영상을 이용하여 7개 항목에 대한 농작물 재배지 분류를 시행하였다. 작물 분류 방법은 광지역 무인기 영상의 색감, 형태 및 질감 등의 특성을 고려한 객체기반 분류 기법을 이용하여 정확도를 향상시켰다. Yang et al. (2017)은 무인기 영상을 이용하여 쌀 생산량 평가를 시행하면서 수치표면모델 (Digital Surface Model, DSM)과 통계학적 이론에 근거한 single feature probability (SFP)를 이용하여 분류 방법을 제안하였다. 그 결과 정확도 (over accuracy)는 96.2%로 높게 분류된다고 보고하였다. Lottes et al. (2017)은 경량 무인기 영상을 기반으로 사탕수수와 일반 잡초를 분류하는 연구를 수행하면서 제초제의 적정량을 산출하는데 활용하였다. 얻어진 결과는 Excess green index (ExG) 식생지수를 이용한 경우 86.0%의 재현율을 나타낸다고 보고하였다.

머신러닝을 활용한 방법은 빠르게 발전하면서 농업분야에서도 작물 분류에 활용되고 있다 (Lee et al. 2021). 딥러닝은 빅데이터가 구성된 영역부터 활용성이 높아지면서 농업분야에서도 축적되기 시작한 빅데이터 영상에 접목하려는 시도가 진행되고 있다. 농업분야에서는 빠르게 발전하는 무인기 및 딥러닝 기술을 응용하여, 관심 지역 내 필지 및 작물 등의 대상을 빠르고 정확하게 구분할 수 있는 기술을 필요로 하고 있다.

본 연구는 무인기 영상과 딥러닝 알고리즘을 이용하여 농업 분야에서 대상 작물 분류 고도화를 도모하고자 하였다. 이를 위해 연구대상은 옥수수 재배 필지를 설정하고 영상 구축은 무인기 촬영 영상을 이용하였다. 딥러닝 모형은 재배 필지 추출을 위해 Attention U-Net을 이용하여 모형 적용 가능성을 평가하고자 하였다.

2. 연구지역 및 재료

2.1 연구지역

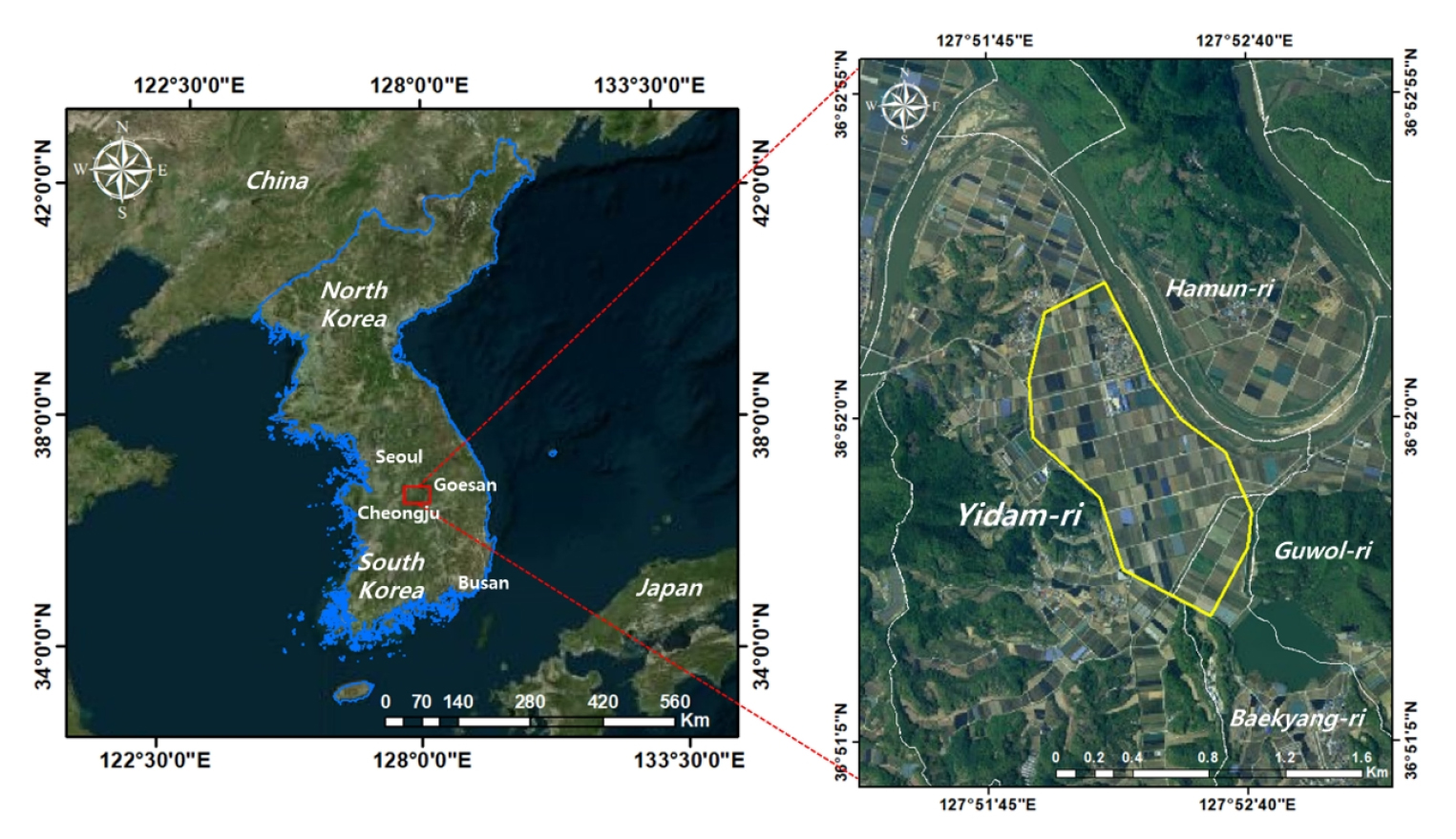

연구대상 지역은 무인기 영상을 이용하여 옥수수 재배 필지를 추출하기 위해 Fig. 1과 같이 충북 괴산군 감물면의 이담리 (36°52′03″N, 127°52′02″) 일대를 선정하였다. 충북 괴산군에는 미백찰, 대학찰과 같은 식용 옥수수가 주로 재배되고 있다. 괴산군 감물면의 옥수수 재배면적은 2017년 농업경영체 등록 기준 141.4 ha로써, 지역 면적대비 재배면적 비율이 가장 높은 지역이다 (MAFRA, 2017).

2.2 연구재료

2.2.1 무인기 영상

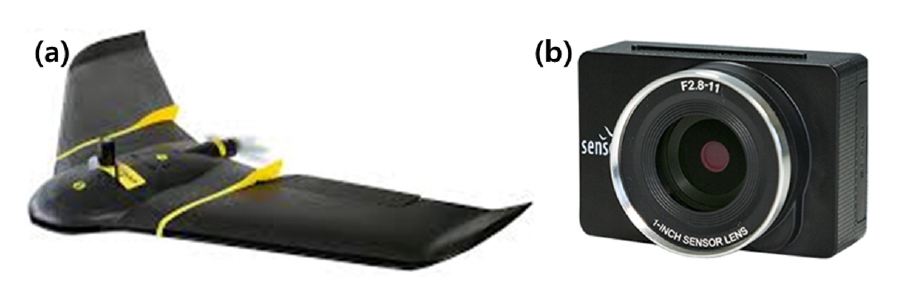

무인기 영상 촬영은 훈련자료 및 모형 평가를 위해 생육조사 시기에 맞추어 2020년 6월 18일에 수행하였다. 촬영은 emotion 3 (Sensefly, Cheseaux-sur-Lausanne, Swiss) 소프트웨어를 이용하여 충북 괴산군 감물면에 대해 산지, 비 농경지를 제외한 2,520 ha의 면적을 계획하여 촬영하였다. 무인기는 대상지역 옥수수 재배 필지 분류를 위해 고정익 기체인 eBee Plus (Sensefly, Cheseaux-sur-Lausanne, Swiss)를 사용하였다. 센서는 가시광선 (Red, Green, Blue) 파장 카메라 (S.O.D.A, Sensefly, Cheseaux-sur-Lausanne, Swiss)를 탑재하여 촬영하였다 (Fig. 2 and Table 1).

Table 1.

Specification of UAV and sensor; (a) eBee Plus, (b) S.O.D.A digital camera

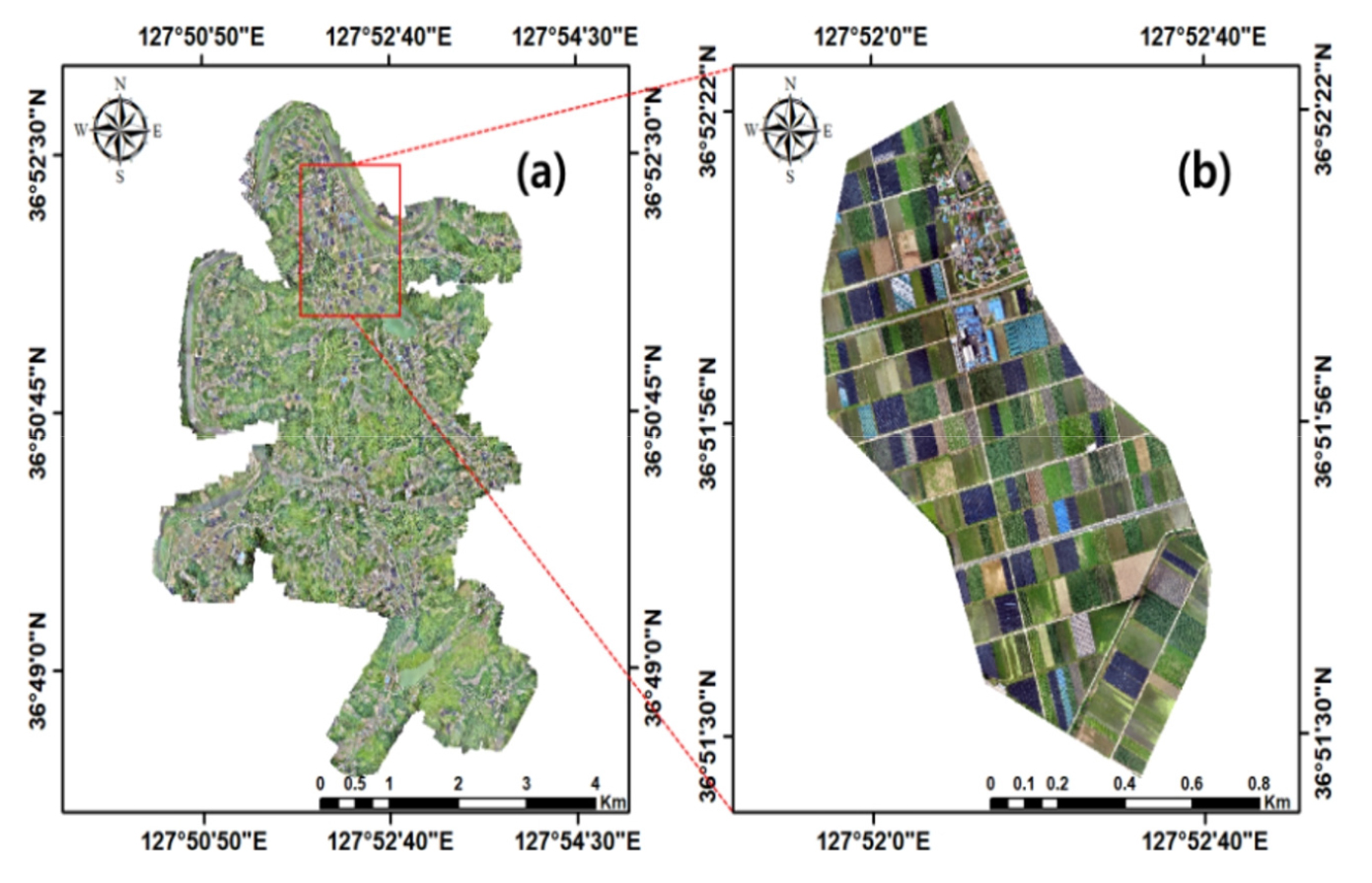

영상은 총 3,802장이 촬영되었다. 영상처리는 촬영 당시 무인기 위치정보 및 자세 등 표정 요소와 결합한 후, 전처리 프로그램인 Pix4D Mapper (Sensefly, Cheseaux-sur-Lausanne, Swiss)를 이용하여 영상정합을 실시하였다. Fig. 3 (a)는 충북 괴산군 감물면 전체를 촬영한 영상이다. 감물면 전체 영상은 행정경계를 기준으로 분할하였다. 본 연구에서는 딥러닝 기반 옥수수 재배 필지 추출을 위하여 Fig. 3 (b)와 같이 충북 괴산군 감물면 이담리를 대상으로 하였다.

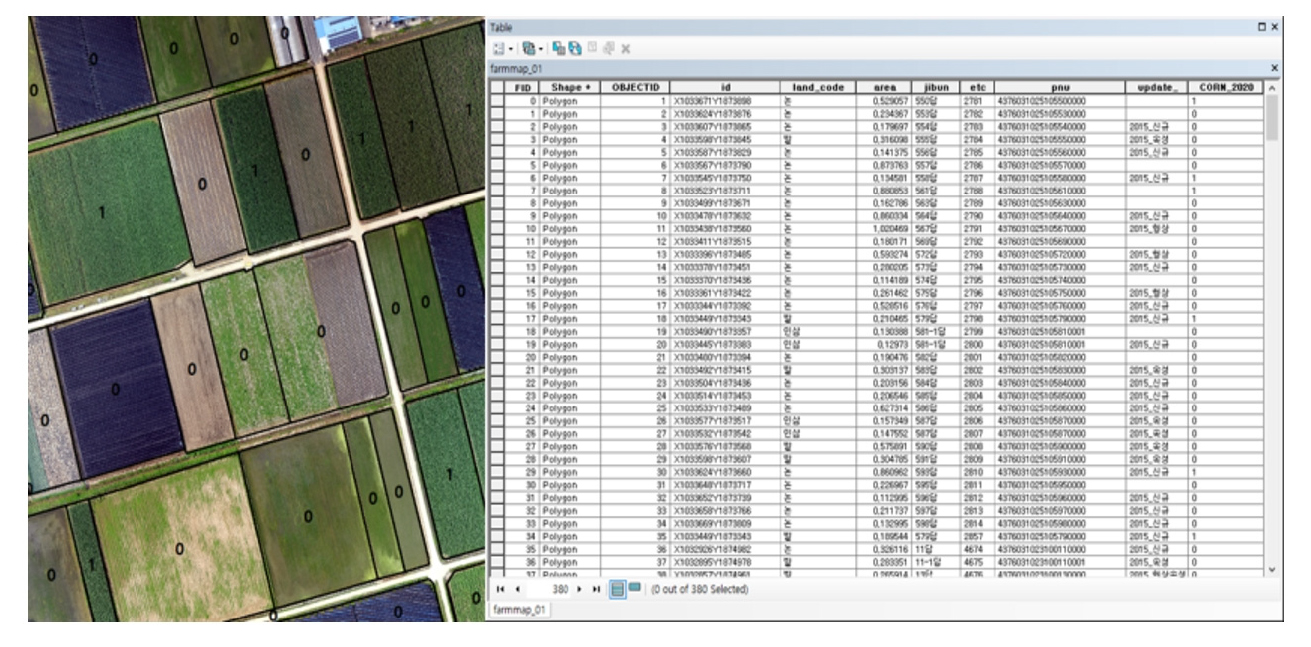

2.2.2 현장조사

현장조사는 대상지역 옥수수 재배필지 분류를 위한 참조자료 생성을 위해 각 필지에 대해 실시하였다. 현장조사는 육안으로 수행하고 태블릿 pc 지도에 기록하였다. 옥수수 구분은 팜맵 경계를 기준으로 옥수수 재배 필지를 1, 타작물을 0으로 기입하여 구분하였다 (Fig. 4).

3. 연구방법

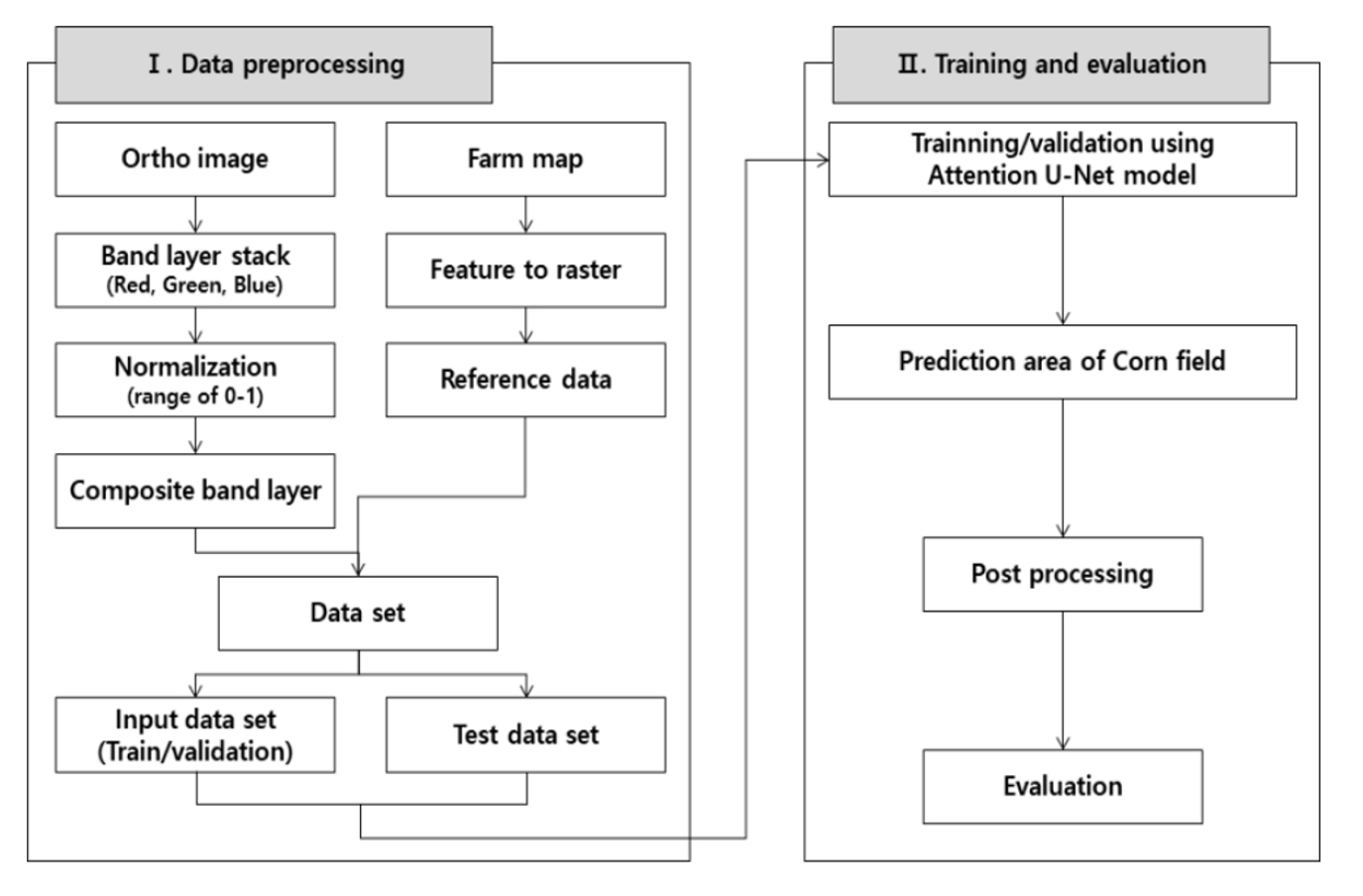

딥러닝 기반 옥수수 재배필지 추출은 Fig. 5와 같이 학습자료 생성 (data preprocessing), 옥수수 재배필지 추출 및 평가 (training and evaluation) 단계로 수행하였다.

영상패치 (image patch)는 무인기 정사영상을 이용하여 모형의 학습 (training) 및 검증 (validation)을 위해 생성하였다. 참조자료 (reference data)는 팜맵을 활용하여 구축하였다. 영상패치는 딥러닝 기법 중 하나인 Attention U-Net 모형에 적용하였다. Attention U-Net 모형에서 작물을 구분하기 위해서는 임계값 설정이 필요하다. 따라서 임계값은 모의된 영상패치 내에서 객체별 변화량에 대해 설정하고, 이를 이용하여 옥수수 재배 필지 추출에 대한 모형 평가를 수행하였다.

3.1 학습자료 및 검증 데이터 구축

일반적으로 딥러닝에서는 학습 속도 향상과 비용함수 (cost function) 최적화를 위해 입력자료의 각기 다른 스케일을 일정한 범위로 변환하는 정규화가 필수적이다 (Sameen et al. 2018). 모형 구축 데이터를 위해 정규화 (normalization)는 연구대상지역에 대한 무인기 영상에서 Red, Green, Blue 밴드를 추출하여 수행하였다.

정규화는 모든 픽셀이 동일한 정도 스케일로 반영되도록 가장 일반적인 최소-최대 정규화 (min-max normalization) 방법을 각 밴드별로 적용하였다 (Eq. 1).

여기서 N은 정규화 값이며, x는 해당 픽셀의 DN (Digital Number), xmax와 xmin은 해당 영상의 최대 및 최소 DN이다.

정규화를 수행한 Red, Green, Blue 영상은 각각 단일밴드로 되어 있으며, 모형 입력자료 구축을 위해 다중밴드 영상으로 변환이 필요하다. 이에 따라 밴드합성 (band composite)을 수행하고, 영상패치는 밴드합성 영상을 이용하여 학습 및 검증 자료로 제작하였다. 또한 참조자료 생성은 팜맵 및 현장조사 자료를 이용하였으며, shape 파일 형식인 벡터 데이터를 래스터 데이터로 변환하였다.

생성된 이미지는 모형 훈련과 일반화, 그리고 모형 성능평가를 위해 사용하였다. 데이터는 모형의 학습, 일반화 및 모형 성능평가에 사용되는 데이터 셋으로 구분하였다. 데이터 셋은 훈련 데이터 셋 (training data set), 검증 데이터 셋 (validation data set) 및 테스트 데이터 셋 (test data set)으로 구축하였다.

3.2 Attention U-Net

U-Net 모형은 생의학 분야에서 세포의 경계추출을 위해 주로 사용되었다. U-Net은 다양한 영상 분할에 사용되는 인공신경망 (Convolutional Neural Network; CNN) 중 하나이다 (Ronneberger et al. 2015). U-Net 모형은 생의학 분야에서 영상분할을 목적으로 개발되었지만, 충분하지 않은 정보로 영상 분할 (imagery segmentation)이 가능하다는 특징 때문에 위성영상 기반의 토지피복분류에도 활용되고 있다 (Ulmas et al. 2016; Lee and Lee 2020).

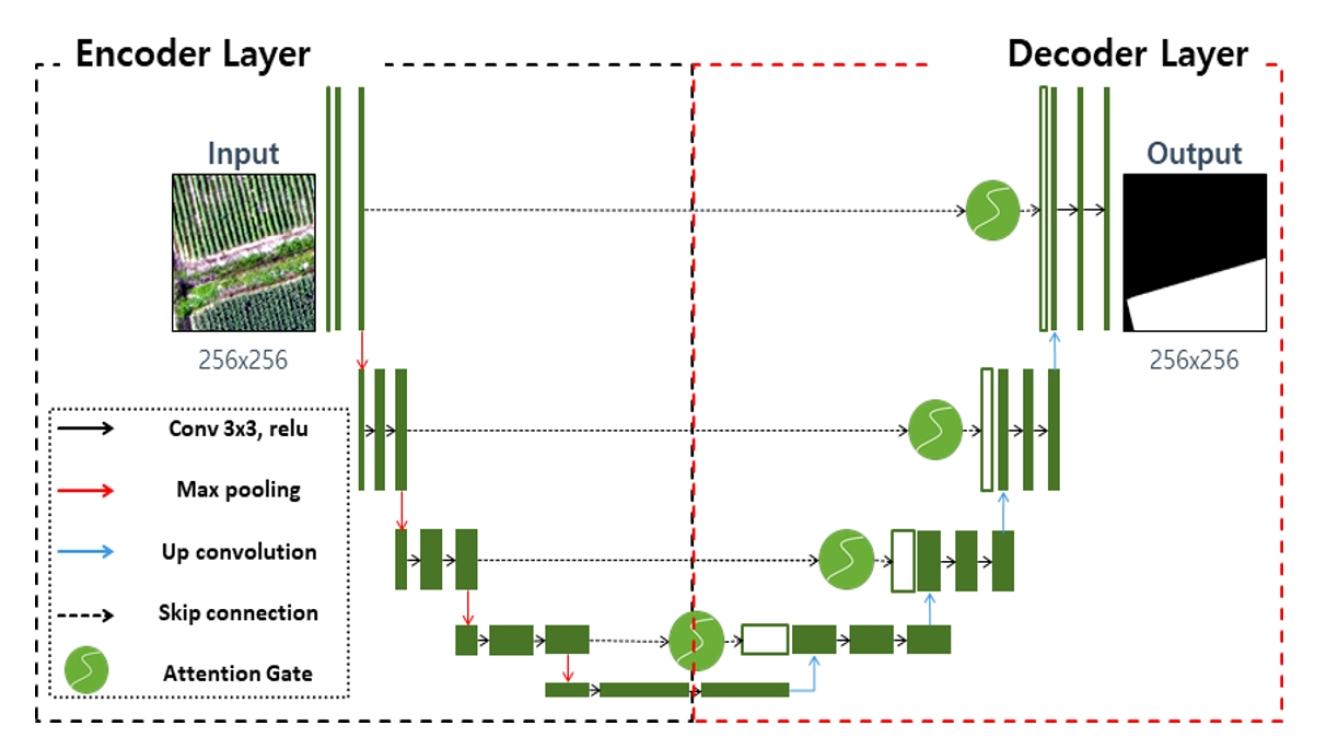

Fig. 6과 같이 본 연구에서 사용한 Attention U-Net 모형은 U-Net 모형을 기초로 하고, Attention gate를 추가 적용한 알고리즘이다. Attention U-Net 모형은 특정 작업에 유용한 특징을 강조하면서 입력되는 이미지에서 관련 없는 영역을 억제하는 장점을 가지고 있다. 또한 기본 U-Net과 달리 이전에 사용된 영상 특징을 다시 주목하여 사용한다. 즉, Attention U-Net은 영상을 확대하는 디코더 부분에서 같은 층에 해당되는 인코더 층보다 한 단계 낮은 인코더 층의 저해상도 영상 특징을 사용하게 된다. 여기서 인코더 영상 특징은 디코더 부분에 그대로 반영하는 것이 아니라, Attention gate를 통과하게 한 후 Attention gate로 연산된 값을 디코더 부분에 주입하는 과정을 거친다 (Schlemper et al. 2019).

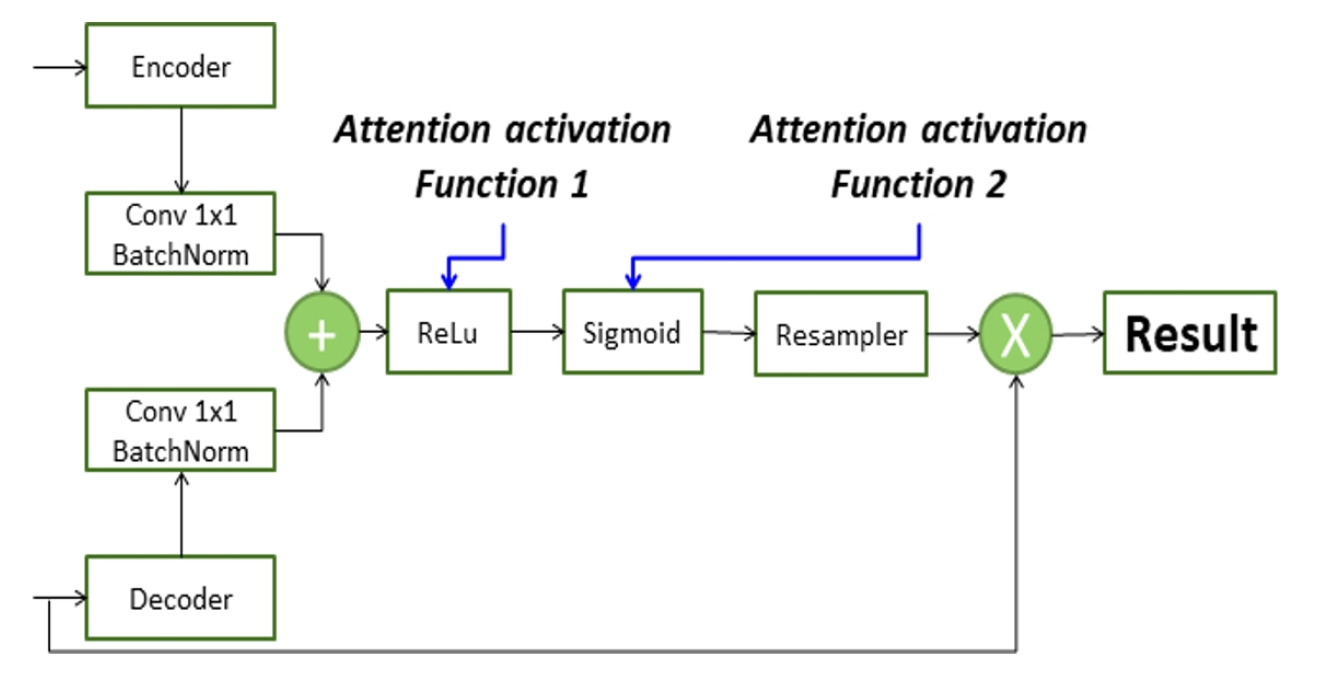

Attention gate 구조는 Fig. 7과 같다. 컨볼루션과 배치 정규화 층은 인코더 영상과 디코더 영상 사이에 적용하여 각각의 모든 값을 합한 영상에 대해 Attention 활성화 함수 1과 2를 차례로 거치도록 한다. 이후에는 다시 재배열하여 추출된 영상 특징을 디코더 층으로 반영하도록 하는 과정으로 진행된다 (Schlemper et al. 2019).

Attention U-Net 모형은 다른 인공신경망 모형과 같이 각 층에 대한 활성화 함수 (activation function)를 지정해줘야 한다. Attention U-Net 모형은 인코더 및 디코더 층을 비롯해 Attention gate 내 Attention 활성화 함수 및 출력 (output) 활성화 함수를 지정하도록 설계되어 있다. 본 연구에서는 모든 활성화 함수를 ReLU로 설정하여 모형의 훈련 및 추출을 시행하였다. 일반적으로 ReLU 함수는 기울기 값이 사라지는 현상 (gradient vanishing)을 피할 수 있으며, 모형의 최적화 효율이 높은 것으로 보고되고 있다 (Chen et al. 2019).

또한, 학습을 위한 하이퍼파라미터 (hyperparameter)는 Table 2와 같이 설정하였다.

Table 2.

Hyperparameter for training

| Optimizer | Initial learning rate | epochs | Batch size |

| AdaBelief | 10-3 | 150 | 16 |

3.3 모형학습의 성능 평가

지도학습을 이용하는 Attention U-Net 모형은 실측치와 예측치 간의 오차를 반복적으로 감소시킨다. 이를 위해 지속적으로 신경망 내 가중치 (weighted value)는 개선되는 방법을 사용한다. 일반적으로 신경망 분야에서 오차는 손실 (loss)로 언급된다. 지도학습 목표는 손실을 최소화하여 모형을 최적화하는데 있다. 모형의 훈련 정도는 손실 변화로 판단할 수 있다. 손실 변화는 손실함수를 설정하여 모니터링 할 수 있다. 일반적으로 U-Net의 손실함수는 평균 제곱 오차 (mean squared error, MSE)와 교차 엔트로피 오차 (cross entropy) 등이 사용된다. 본 연구에서는 로그 쌍곡탄젠트 (log hyperbolic tangent) 함수를 손실함수로 이용하였다 (Eq. 2).

여기서 log tanh x는 쌍곡탄젠트에 로그를 취한 것이다.

로그 쌍곡탄젠트 함수는 시그모이드 (sigmoid)함수와 달리 편향 이동이 발생하지 않는 장점을 갖는다. 모형 학습 과정 중 예측 성능은 모형 훈련에서 검토해야 할 항목이다. 본 연구에서는 Eq. 3과 같이 검토지표 (metric)로 평균절대오차 (mean absolute error, MAE)를 사용하였다.

여기서 MAE는 평균절대오차, n은 샘플 개수, y’i는 예측값, yi는 실측값을 의미하며, |y’i –yi |는 절대오차이다.

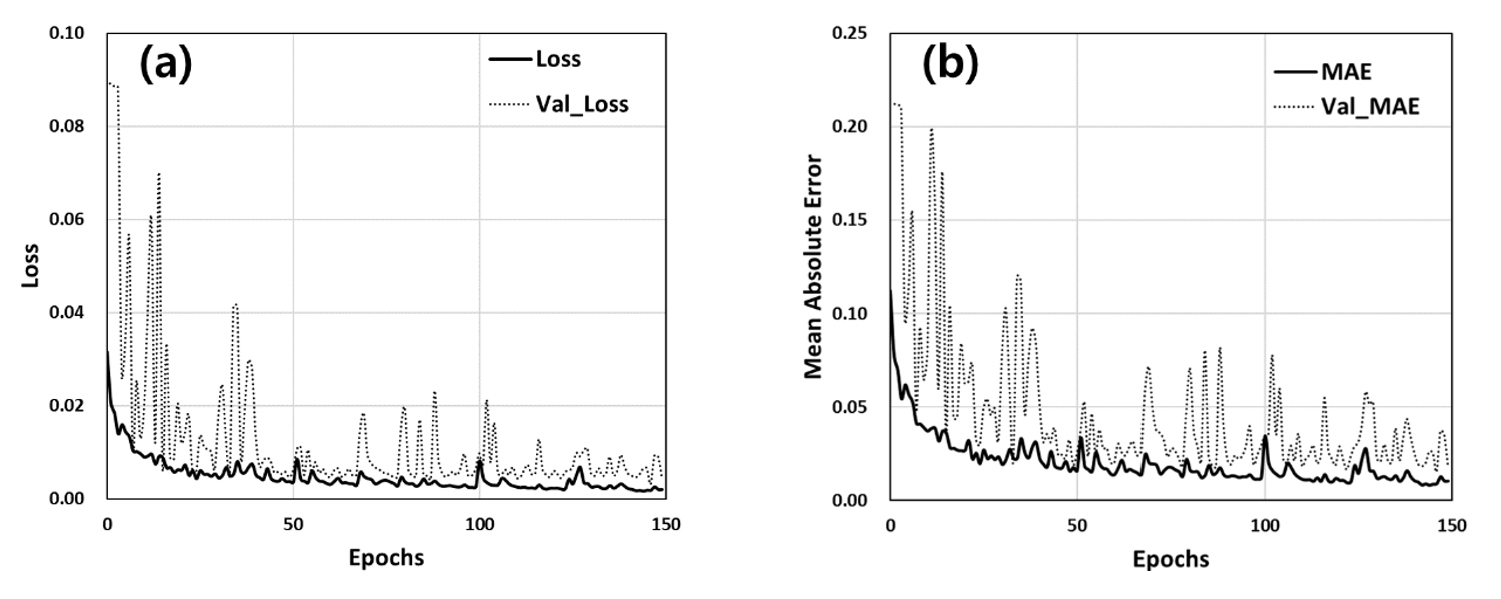

Attention U-Net 모형 학습결과에 대한 판단은 Loss, MAE, Val_Loss (Validation Loss) 및 Val_MAE (Validation MAE)를 이용하였다. 여기서 Loss 및 MAE는 학습 데이터 셋을 이용한 모형의 학습 결과를 나타내며, Val_Loss 및 Val_MAE는 검증 데이터 셋을 이용한 모형의 일반화를 판단하는 지표이다. 신경망 모형 분야에서는 학습결과를 판단하는 명확한 기준은 없다. 그러나 일반적으로 반복횟수 (epoch)가 많아질수록 Loss, Validation Loss, MAE 및 Validation MAE 밑수 (base)는 0 이하인 지수함수 그래프와 유사한 형태로 나타난다. 궁극적으로 해당 수치가 Y축 0에 가까워지면 모형 학습이 충분히 진행된 것으로 판단한다. 또한, 지표 감소 경향이 안정적으로 충분히 0에 수렴하면 높은 모형 성능을 담보할 수 있다. 이와 함께 학습 데이터 지표인 Loss 및 MAE와 검증 데이터 지표인 Val_Loss 및 Val_MAE는 크기 및 변화를 확인해야 한다. 만약 Val_Loss 및 Val_MAE 크기가 Loss 및 MAE 크기보다 작으면 이는 모형이 과적합 (overfitting) 되었음을 의미하므로 모형 예측 결과에 대한 신뢰성을 확보할 수 없게 된다. 따라서 본 연구에서는 이러한 현상이 발생하지 않도록 모형 성능을 유지하였다.

3.4 옥수수 재배 필지 추출 및 모형 성능평가

옥수수 재배 필지 추출 모의는 무인기 영상을 Attention U-Net 모형에 적용하여 학습한 결과와 참조자료 영상패치 내에서 픽셀 위치로 비교하여 모형 성능을 검증하였다. Attention U-Net 모형을 이용하여 재배 필지를 추출한 결과는 최적 임계값 (threshold)을 0.5 이상으로 설정하였다. 임계값 판단은 Otsu (1979) 방법을 사용하였다.

정확도 검증은 Eq. 4~6과 같이 각각 정밀도 (precision), 재현율 (recall) 및 Fmeasure-Score를 이용하였다 (Tong et al. 2021).

여기서 TP, FP 및 FN은 오차행렬 (conpusion matrix)에 의해 도출되는 값으로 각각 True Positive (TP), False Positive (FP) 및 False Negative(FN)을 의미한다 (Tong et al. 2021).

본 연구에서 Eq. 6의 beta는 1로 설정하였다. 선행연구에서 Fmeasure-Score는 F1-Score로 칭하므로 본 연구에서도 같은 방법을 적용하였다. F1-Score는 예측된 결과물과 실제값 사이 정밀도와 재현율을 동일한 가중치로 설정하여 모형 성능을 판단한다.

본 연구에서 모형 구축, 훈련 및 성능평가는 Intel® Core ™ i9-9000K CPU @ 3.70GHz, 32G RAM과 NDIVIA® GEFORCE RTX ™ 2070 GPU Window-OS 기반 노트북에서 수행하였다. 자료 작성은 Python 3.7 (www.python.org 2018) 언어를 이용하였다. 모형 설계, 구현 및 운용 등은 Keras (Keras, 2021)를 사용하였다. Keras는 Google에서 공개한 머신러닝 라이브러리인 Tensorflow (www.tensorflow.org)를 backend로 이용하고, Python으로 작성된 고수준 DNN API (deep neural network application programming interface)로, Tensorflow의 특수 기능을 모두 지원하며, DNN 모형 구현의 유연성이 매우 높다. 또한, Keras는 CPU와 GPU를 효율적으로 사용할 수 있기 때문에 빠른 실험이 가능한 특징을 갖고 있다.

4. 연구 결과 및 분석

4.1 데이터 셋 구축 결과

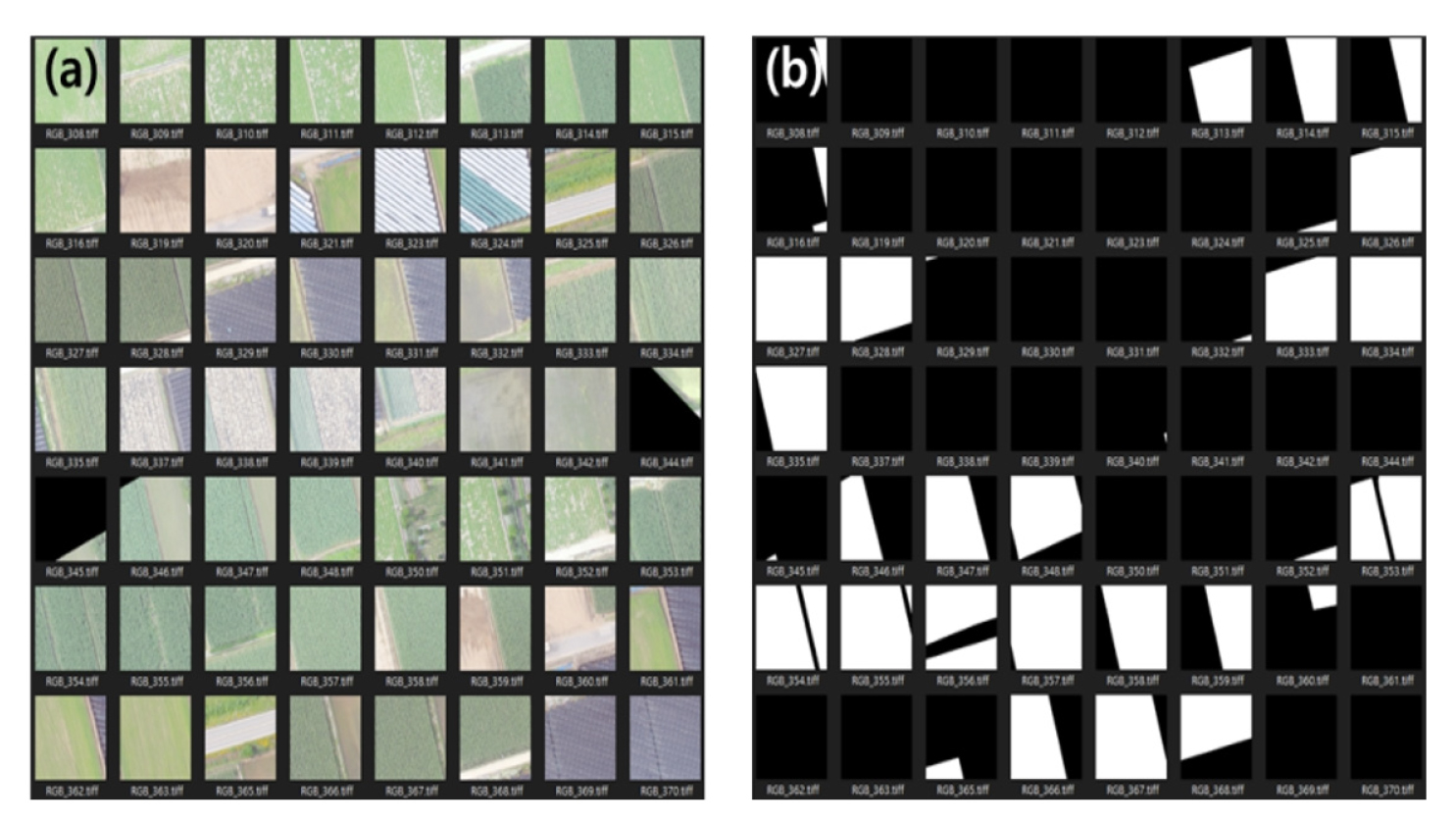

학습 및 검증 데이터 구축은 밴드별 정규화 과정을 수행한 후 밴드를 통합한 (composite) 무인기 영상을 입력 자료로 활용하였다. 출력 자료는 옥수수 재배 필지 구간을 구분할 수 있도록 0 - 1범위 값을 갖는 확률맵 (probability map)으로 추출하였다. 또한 참조자료에 대한 영상패치는 현장조사 및 경계 보정을 완료한 팜맵을 기준으로 농업 경작지 영역만 추출하였다. 연구대상지인 충북 괴산군 감물면 이담리는 총 380필지가 존재하였다.

Attention U-Net 모형의 학습 및 성능평가를 위한 자료는 정규화를 수행한 영상과 팜맵을 기초로 한 참조영상 (ground truth)을 이용하여 256 × 256 크기로 설정한 영상패치 (image patch)를 분할하여 구축하였다. Fig. 8은 본 연구에서 구축한 영상패치 중 일부를 나타낸 것이다.

총 1,702개 영상패치 중 1,361개는 모형 입력 자료 (input data set)로써, 이 중 90%는 모형 학습을 위한 학습 데이터 셋이다. 나머지 10%는 모형 학습에 대한 검증을 위한 검증 데이터 셋으로 사용하였다. 또한, 전체 영상패치 중 20%인 341개는 모형 성능평가를 위한 테스트 데이터 셋으로 사용하였다 (Table 3).

Table 3.

Divided data Set for Attention U-Net model in this study

| Data set | Number of data | |

| Input | Training | 1,225 |

| Validation | 136 | |

| Test | Test | 341 |

4.2 모형 학습 결과에 대한 평가

본 연구의 모형 학습 결과는 Fig. 9와 같다. 학습 데이터 셋 지표 중 Loss는 첫 실행에 0.03으로 시작하여 마지막 실행에 0.002로, MAE는 0.11에서 0.01로 감소하였다. 검증 데이터 셋 지표 중 Val_Loss는 첫 실행에 0.09로 시작하여 마지막 실행에서 0.004로, Val_MAE는 0.21에서 0.01로 감소하였다. 결과적으로 Attention U-Net 모형의 모든 지표는 모든 그래프에서 진폭 크기가 크게 나타나 이상적인 학습 상태를 보이지 않으나, 실행 반복에 따라 0에 가깝게 수렴하였다. 또한, Fig. 9 (a) 및 (b)와 같이 검증 데이터 셋 지표가 학습 데이터 셋 지표보다 높게 나타나 과적합은 발생하지 않았다. 이에 본 연구에서는 해당 결과를 통해 모형 학습 및 일반화가 모두 충분히 진행된 것으로 판단하였다.

4.3 모형 성능평가

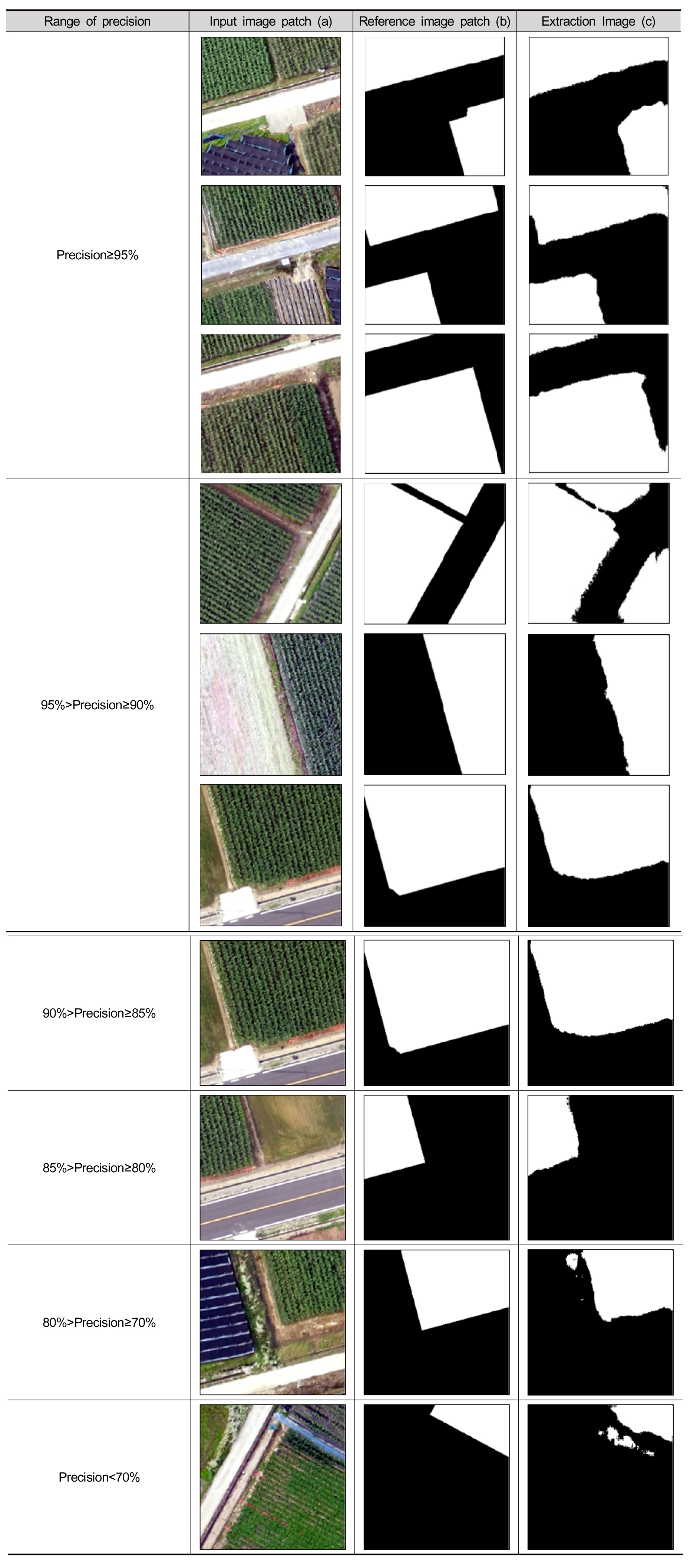

Attention U-Net과 같은 딥러닝 모형은 선행된 학습자료에서 높은 정확도를 나타내므로, 실제적으로 활용하려면 비학습 자료에 적용하여 모형 성능을 검토해야 한다. 본 연구에서는 학습하지 않은 데이터, 즉 Table 3의 테스트 데이터 셋을 앞서 훈련된 Attention U-Net 모형에 적용하여 연구대상지역 옥수수 재배 필지를 추출하고, 이에 대한 성능평가를 실시하였다. 얻어진 결과는 Fig. 10과 같다. 추출된 옥수수 재배 필지 (Fig. 10 (c))는 정밀도가 증가할수록 참조 영상패치 (Fig. 10 (b))와 일치하였으며, 정밀도가 낮아질수록 추출된 이미지 형태가 점차 어그러지는 경향을 나타내었다.

본 연구의 모형 성능 평가는 총 3가지 평가 지표 즉, 정밀도, 재현율 및 F1-Score에 대해서 실시하였다. 정밀도는 모형이 옥수수 필지 픽셀이라고 예측한 데이터 중에서 실제 옥수수 필지 픽셀이 차지하는 비율을 나타낸다. 재현율은 실제 옥수수 필지 픽셀 중 모형이 옥수수 필지 픽셀로 예측한 비율을 의미한다. F1-Score는 정밀도와 재현율의 조화 평균을 의미한다. 본 연구에서 얻어진 정밀도, 재현율 및 F1-Score는 Table 4와 같이 각각 0.94, 0.96 및 0.92로 모형 성능이 매우 높은 것으로 나타났다.

이와 유사한 선행연구로 Zang et al. (2018)은 기존 U-Net 모형에 잔차 신경망을 삽입하여 Residual U-Net을 개발하였다. 개발한 모형은 미국 매사추세츠주 항공영상에 적용하여 도로 자동 추출 연구에 대해 수행하였다. 연구 결과 재현율은 0.92로 보고하였다. 또한 Seong et al. (2020)은 RapidEye 위성영상을 이용하여 작물 재배지역에 대한 훈련자료를 구축하고, 이를 활용하여 국내 양파 및 마늘 작물에 대한 재배면적을 추정하였다. 그 결과 정밀도는 0.90, 재현율은 0.93 및 F1-Score는 0.91로 나타남을 보고하였다.

본 연구 수행 결과는 선행연구 결과와 유사하거나 다소 높은 정확도를 나타냈다. 따라서 본 연구는 신뢰성을 확보하였다고 판단할 수 있다.

5. 결 론

본 연구에서는 위성영상 촬영 한계를 극복하고 재배 필지 파악 기술 발전에 기여하고자 무인기 기반 정사영상과 현장조사 및 팜맵을 이용하여 딥러닝 모형과 접목하는 기술을 개발하고자 하였다. 요구되는 딥러닝 모형 학습자료는 무인기 영상을 활용하여 생성하고, 옥수수 재배 필지를 추출한 뒤 성능평가를 실시하여 본 연구 방법론에 대한 적용 가능성을 평가하였다. 적용 모형은 대표적인 의미론적 분할 딥러닝 모형인 Attention U-Net을 활용하였다. 학습 결과에 대한 평가 방법은 Loss, MAE, Val_Loss, Val_MAE를 이용하였다. 모형 학습 결과는 학습 반복에 따라 0에 가깝게 수렴하였다. 이로써 모형 학습 및 일반화는 충분히 진행된 것으로 나타났다. 모형 성능 평가 결과는 정밀도 0.94, 재현율 0.96 및 F1-Score 0.92로 나타났다. 이 결과는 옥수수 재배필지를 분류하는데 있어서 Attention U-Net 모형이 유용한 분류 도구가 될 수 있다는 것으로 해석된다.

그러나, 본 연구는 행정단위 ‘리’의 비교적 좁은 지역을 대상으로 수행하였기 때문에, 행정단위 ‘면’과 같은 광지역에 대해 적용하여 모형의 적용 가능성을 도출 할 필요성이 있다. 또한, 본 연구는 가시광 영역인 Red, Green, Blue 밴드만 이용하였다. 따라서 보다 정밀한 모형 구축은 식생 성장 특성을 알 수 있는 레드엣지 (Rededge) 및 근적외선 (Near infrared) 밴드를 추가하면 가능할 것으로 생각된다. 이와 함께 추가적인 연구로는 Attention U-Net 모형 외에 유사한 모형을 적용하여 그 결과를 비교 분석하는 연구 등이 필요할 것으로 판단된다.