1. 서 론

2. 연구동향

2.1 색상필터 기법

2.2 형태필터 기법

3. 연구 방법

3.1 분석 대상

3.2 분석 방법

4. 결과 및 고찰

4.1 식생 필터링 결과

4.2 식생 필터링 결과와 원지반 비교

5. 결 론

1. 서 론

하천 제방은 유수, 강우, 바람, 차량, 동식물, 인위적 행위 등에 의해 지속적으로 영향을 받으며 손상되거나 변형이 발생한다. 제방의 손상 또는 노후화로 인한 파괴양상은 외부침식, 내부침식, 비탈면 불안정등으로 나타나며 파괴과정은 침식, 하안포락, 패임, 침하, 침투, 비탈면 불안정, 균열, 동물서식구멍 등이다 (CIRIA 2013). 제방 유지관리를 위한 관찰과 평가를 위해서는 제방의 점검과 검사가 필수적이다. 점검과 검사는 외형조사와 제체내부조사로 크게 구분할 수 있는데, 우리나라를 포함하여 미국, 일본, 유럽 등에서도 일상적이고 기본적인 조사는 외형조사이다. 외형조사는 파괴과정을 모니터링하는 것으로 제방 외형의 변형여부와 그 규모를 지속적으로 모니터링하는 작업이다. 그러나 외형조사는 대부분 인력에 의한 육안조사로 진행되고, 제방은 대부분 흙으로 구성되어 식생이 무성한 상태여서 대규모의 손상이나 변형이 발생하지 않는 경우에는 이상지점을 파악하기 매우 어렵다. 이 때문에 일본과 미국 등에서는 제방에 대한 엄격한 식생관리를 통해 제방 외형의 변화를 육안으로 쉽게 파악하도록 하고 있으나 우리나라의 경우 인력과 예산 상의 문제, 환경적 요구로 제방 식생이 무성한 것이 일반적이다. 즉, 현재 우리나라 제방에서 외형조사로 중소규모의 이상지점을 파악하는 것은 어려워 제방 유지관리의 기본조사를 제대로 수행할 수 없는 문제가 있다.

이러한 문제를 해결하기 위하여 최근 지형의 정밀한 측정이 가능한 항공 및 지상 LiDAR (Light Detection And Ranging)의 적용이 확대되고 있다. LiDAR 측량은 지형의 정밀한 변위 측정이 가능하므로 제방 외형의 변화를 정밀하게 조사할 수 있는 효과적이 대안이 될 수 있다. 그러나 대부분의 제방은 식생이 무성한 상태로 정밀한 변위 관측을 위해서는 LiDAR 측량 결과로부터 식생을 제거하는 것이 필수적이다. 그런데 최근의 LiDAR 장비는 포인트의 위치정보에 색상정보가 포함된 영상 점군 자료 수집이 가능하여 색상정보를 이용해 포인트를 분류하는 기존의 영상분류기법을 활용할 수 있게 되었다. 색상필터를 점군에 적용하여 식생 구분의 정확도와 식생 높이를 결정하는 다양한 연구가 수행되었다(Yilmaz et al. 2016).

그러나 제안된 필터링 기법들은 항공 LiDAR 측량 결과나 사진에 대한 수목 또는 농작물 추출을 위해 개발된 것으로 제방 변위 관측에 대한 적용하기에는 한계가 있을 것으로 보인다. 게다가 우리나라에서는 아직까지 항공 LiDAR를 제방 모니터링에 적용하기에는 비용과 비행허가 등의 문제로 곤란한 상황이다. 따라서 본 연구에서는 지상 LiDAR를 이용해 하천 제방 변위 조사의 가능성을 평가하고자 한다. 이를 위해 식생이 있는 제방의 지상 LiDAR 측량 결과를 기존의 항공 LiDAR 자료를 대상으로 적용되는 색상 및 형태 필터링 기법들을 적용해 식생을 제거하고 원지반과 비교하여 필터링 기법별로 비교와 평가를 수행하였다.

2. 연구동향

LiDAR는 최근 DTM (Digital Terrain Model) 생성을 위한 점군 획득을 위해 가장 널리 활용되는 기술이다. LiDAR 측정에서 레이저 스캐너는 항공기, 선박, 차량, 또는 삼각대 등 다양한 장비에 탑재되며 대상 물체에 반사되어 돌아오는 레이저 펄스의 도달 시간을 측정하여 거리를 측정한다. 이때 반사체의 색상정보가 함께 수집되는데 이 정보를 이용하면 손쉽게 흙, 식생, 인공 구조물 등으로 점군을 분류할 수 있다.

LiDAR 자료의 필터링 기법은 다양한 연구를 통해 다수의 기법이 제안되었다 (Meng et al. 2010). 공간좌표와 색상정보가 함께 있는 영상 점군의 분류에 적용하는 식생필터는 색상정보를 이용한 색상필터와 공간좌표를 이용하는 형태필터로 구분할 수 있으며 여기에서는 8가지 색상필터와 2가지 형태필터에 대해서 검토하였다.

2.1 색상필터 기법

일반적인 카메라는 RGB 색상 공간을 사용하는데 관심 대상의 색상을 강조하면 흙 등의 배경 색상은 약화될 수 있다. 그런데 Tian과 Slaughter (1998)에 의하면 RGB 색상을 단순히 흑백영상으로 변환하는 경우에는 식생과 흙 배경이 유사한 회색톤을 가지므로 식생구분이 어렵다. 따라서 대부분의 식생구분방법은 RGB 공간을 다른 색상 공간으로 변환하여 사용한다. 식생을 구분하기 위해 개발된 색상공간의 변환식들을 살펴보면 다음과 같다.

Woebbecke et al. (1995)는 식생과 흙을 구분하는데 색 좌표 (chromatic coordinate)를 이용하는 몇가지 식생 지수 방법을 검토하여 Eq. 1과 같이 ExG (Excess Green Index)를 제안하였다. ExG 기법은 식생과 흙 사이에 명확한 대조를 나타내 식생분류에 널리 적용되고 있다 (Meyer et al. 1998, Lamm et al. 2002, Ribeiro et al. 2005, Guerrero et al. 2012).

여기서 r, g, b 등은 색 좌표로 Eq. 2와 같이 계산한다.

여기서 R*, G*, B*는 정규화된 RGB로 0에서 1 사이의 값을 가지며 Eq. 3과 같이 계산한다.

여기서 R, G, B는 영상의 실제 픽셀의 채널 값이며 24 비트 영상의 경우 Rmax = Gmax = Bmax =255이다.

Meyer et al. (1999)은 인간 망막의 추상체는 적색 64%, 녹색 32%, 청색 4% 등으로 구성되어 있다는 사실로부터 ExR (Excess Red Index) 기법을 Eq. 4와 같이 제안하였으며 이를 잎 영역 구분에 적용하였다. ExR 기법으로 식생 구분은 가능하나 ExG에 비해 정확도는 낮은 것으로 알려져 있다.

Kataoka et al. (2003)은 곡물 생장 상태를 평가하기 위하여 CIVE (Color Index of Vegetation Extraction) 기법을 Eq. 5와 같이 제안하였다. CIVE 기법은 녹색 영역을 강조하므로 근적외선 기법에 비해 양호한 결과를 나타낸다.

Meyer et al. (2004)는 ExG 기법과 ExR 기법을 조합하여 ExGR (Excess Green minus Excess Red Index) 기법을 제안하였다. 이 기법은 ExG 기법과 ExR 기법을 동시에 적용하는데, ExG 기법은 식생 추출에 적용되며 ExR 기법은 흙과 잔여물 등의 배경 노이즈 제거에 적용된다. ExGR은 Eq. 6과 같이 제시된다.

Hunt et al. (2005)는 항공 디지털 카메라 영상을 이용한 곡물 추출을 위해서 NGRDI (Normalized Green-Red Difference Index)를 제안하였다. 이 기법은 카메라 노출 정도에 따른 색상 영역의 왜곡을 개선하기 위하여 제안되었으며 Eq. 7과 같다.

여기서 (G-R)은 식생과 흙을 구분하기 위한 값이며 (G+R)은 다른 영상 간의 빛 강도의 차이를 정규화 하기 위한 값이다.

Hague et al. (2006)은 흙 픽셀에서 식생 픽셀을 구분하기 위한 방법으로 VEG (Vegetative Index)를 제안하였다. 식생 구분을 위해서 RGB 영상은 Eq. 8에 의해 흑백 영상으로 변환된다.

여기서 a는 0.667를 사용한다. Hague는 VEG가 현장 조건에서 식생과 흙 사이의 대조를 잘 나타내며 빛의 변화에도 일관성을 보여준다고 주장하였다.

Burgos-Artizzu et al. (2011)은 통제되지 않은 자연광 상황에서 ExG보다 더 나은 성능을 보여주는 Modified Excess Green (MExG) Index를 개발하였는데, 이 방법은 변하는 조명 환경에서도 식물과 토양 영역을 구별하는데 안정적이고 효과적이었다고 한다. MExG를 나타내는 지수식은 Eq. 9와 같다.

VVI (Visible Vegetation Index)는 가시 스펙트럼의 정보만을 사용하여 이미지의 초목 또는 녹색의 양을 측정하기 위해 개발된 지수이다. 일반적으로 근적외선의 정보는 위성영상에서 토양 또는 얼음표면과 식물을 구별하고 분리하는데 필요하다는 것이 잘 알려져 있고, 식생의 활성도를 측정하는데 NDVI(Normalized Difference Vegetaion Index)와 같은 지수가 사용된다. 하지만 R, G, B와 같은 가시영역의 채널 외에 적외선 영상의 정보가 추가적으로 필요하므로 일반적인 영상에는 적용할 수 없다. 이를 극복하기 위해 가시광선영역의 정보만 사용하여 식생의 활성정도를 파악하려고 푸에르토리코 대학의 행성 거주가능성 연구소 (Planetary Habitability Laboratory; PHL)에서 개발한 것이 VVI이다. VVI는 Eq. 10으로 계산할 수 있다 (PHL).

VVI에서 RGB0는 기준이 되는 녹색을 나타내는 채널 벡터이고 w는 스케일을 조정하기 위한 가중치이다. 색보정 영상을 사용한 테스트를 통해 24비트 영상에서 RGB0 = [30,50,0]이고, w=1을 표준값으로 사용할 수 있다는 것을 알아냈다. 이때 0으로 나누는 것을 막기 위해 RGB 채널에 10을 추가할 필요가 있다 (PHL).

2.2 형태필터 기법

형태필터는 공간 좌표 정보를 기초로 지형의 형태적 특징을 판단해 지반과 식생 등을 구분하는 것으로 여기에서는 ATIN (Adaptive Triangulated Irregular Networks)과 ISL (Iterative Surface Lowering)을 대상으로 검토하였다.

ATIN은 LiDAR 자료 처리에 많이 활용되는 LAStools의 lasground에 구현된 기법이다. LAStools는 Martin Isenburg가 만든 LiDAR 자료처리도구모음으로 지표 분류를 위해 Axelsson (2000)이 제안한 방법을 lasground로 구현한 것이다.

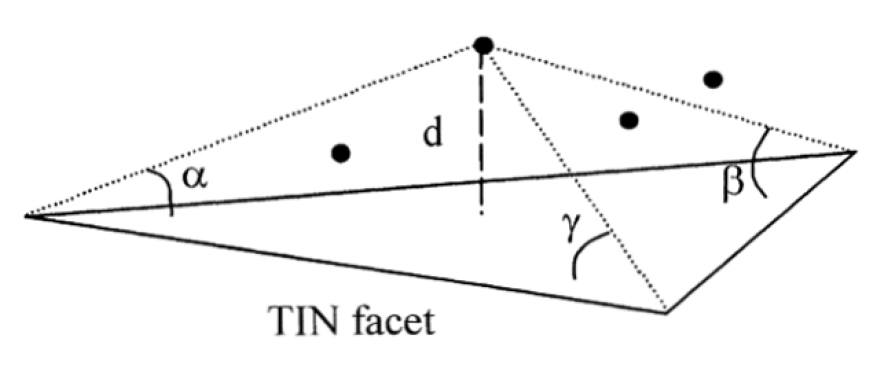

ATIN에서는 점군을 그리드로 나누고 각 타일의 최저점을 초기 접지점으로 하여 성긴 TIN을 생성한다. 다음 단계에서는 Fig. 1과 같이 TIN 표면에서 거리와 TIN 삼각형의 가장 가까운 꼭지점과 연결된 선과 TIN 표면 사이의 각도 등이 기준 이내인 점을 추가하는 작업을 반복적으로 수행하여 조밀한 TIN을 구성한다. 기준은 각 반복 시행에서 자동적으로 계산되어 갱신된다. 최종적으로 생성된 TIN은 지표로 구분하며 제외된 점들은 식생 또는 기타로 구분한다 (Montealegre et al. 2015).

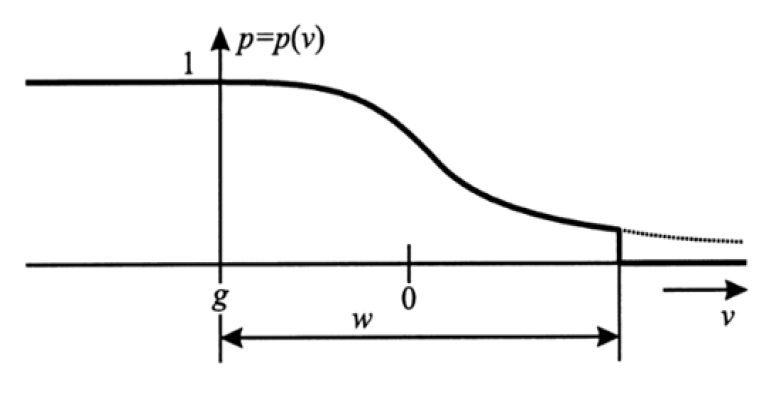

ISL은 지표와 식생을 나누는 기준면을 정하고 지표에서 멀리 떨어질수록 가중치를 낮추는 방법을 사용해 지표와 식생을 나누는 기준면을 재산정하는 반복을 통해 지표를 나타내는 점군을 구분하는 기법이다. 이때 가중치는 다음 식으로 산정한다.

여기서 vi는 점 i와 지표기준면 사이의 편차로서 이 값이 0보다 크면 식생으로 분류하고 0보다 작으면 지표로 분류한다. a와 b는 가중함수의 형상을 결정하는 매개변수로서 Kraus and Pfeifer (1998)는 각각 1과 4를 추천하였다. g는 일반적으로 음수이며 Fig. 2와 같이 가중치에 편이를 부여해 좀 더 빠르게 값이 수렴하도록 한다.

본 연구에서는 앞서 기술된 식생제거기법 중 CIVE, ExG, ExGR, ExR, MExG, NGRDI, VEG, VVI, ATIN, ISL 등 10개 기법을 적용하여 비교하였다.

3. 연구 방법

3.1 분석 대상

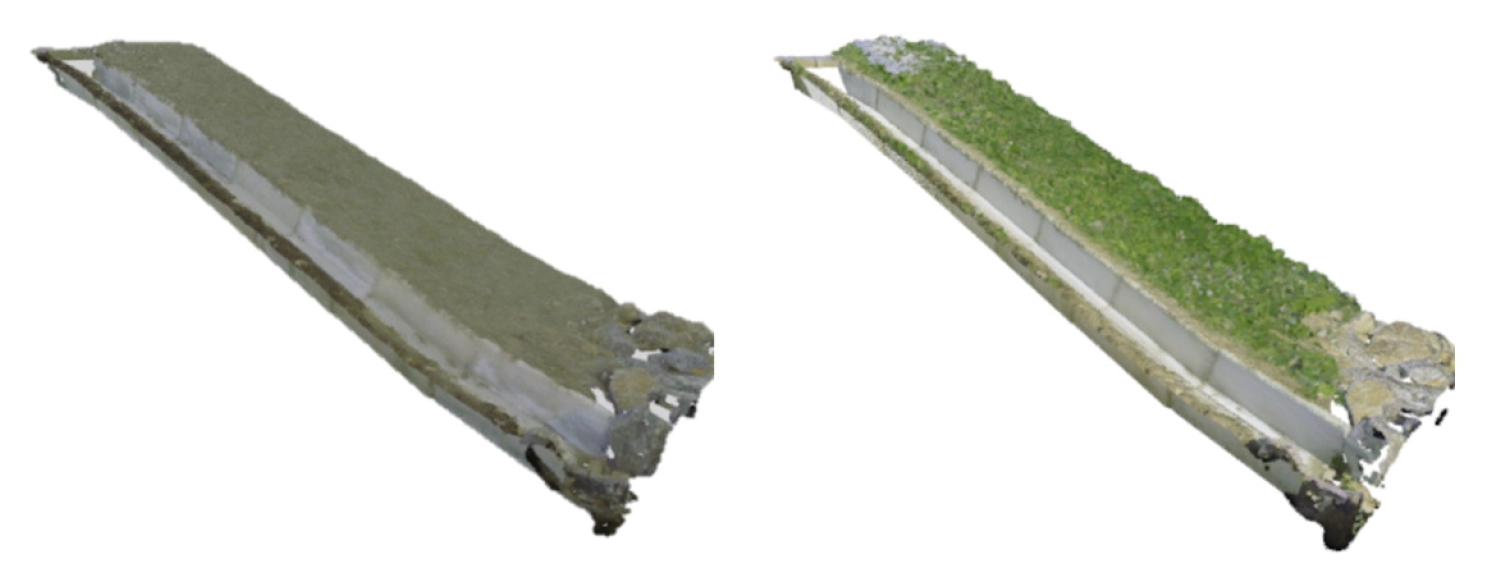

본 연구에서는 RGB 자료 수집이 가능한 지상 LiDAR를 이용하였다. 분석을 위한 대상 지역은 경기도 연천군 군남면에 위치한 임진강 임진교 하류 제방(Fig. 3)이며 2020년 3월 4일 및 5월 13일에 지상 라이더를 이용해 수집된 점군 자료를 이용하였다.

2020년 3월 4일의 영상은 Leica RTC360으로 측량하였으며 5월 13일의 영상은 Leica BLK360으로 측량하였다. 장비 제원 상 RTC360이 BLK360에 비해 성능이 좀 더 우수하지만 두 장비 모두 거리 20 m에서 3D 정확도가 1 cm 미만이므로 대상 지역 면적을 고려했을 때 자료의 비교에는 적합한 것으로 판단하였다. 대상 구간은 제방 사면, 인공 배수로, 거석 등의 다양한 구조가 있는 구간으로 인공 배수로를 이용해 자료의 위치를 가능한 정확하게 일치시켰다(Fig. 4). 이후 인공구조물을 제외한 폭 4.4 m, 사면 연장 14.5 m의 제방 사면 구간을 추출하여 분석하였다. 추출된 3월 자료는 103만 포인트, 5월 자료는 99만 포인트 정도로 구성되어 있다.

식생 제거 대상 영상은 식생이 무성한 5월 영상이며 식생이 거의 없는 3월 영상은 식생이 제거된 지형의 정확도를 검증하기 위하여 사용하였다. 해당 지역에서는 3월에서 5월까지 제방 기초부 이상의 수위 상승이 없어 식생 성장 외의 지형적인 변화는 없는 것으로 판단하였다.

3.2 분석 방법

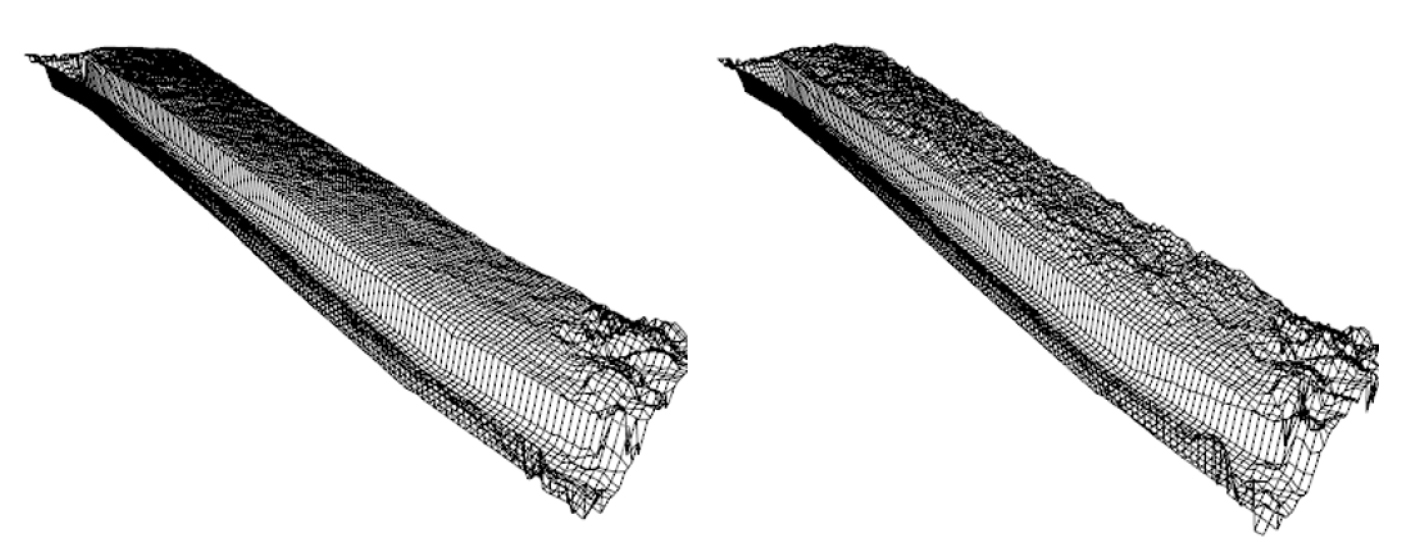

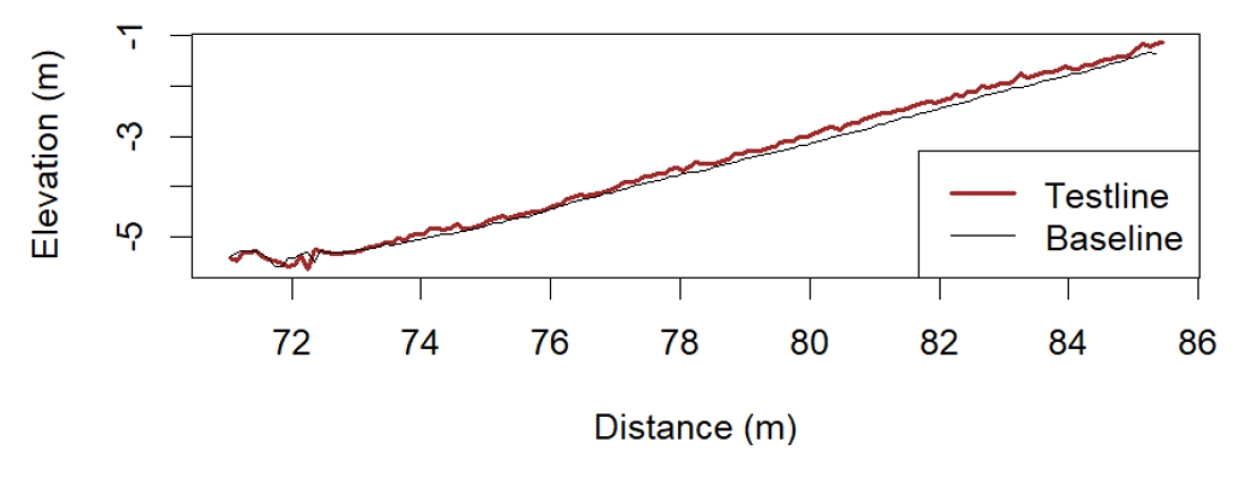

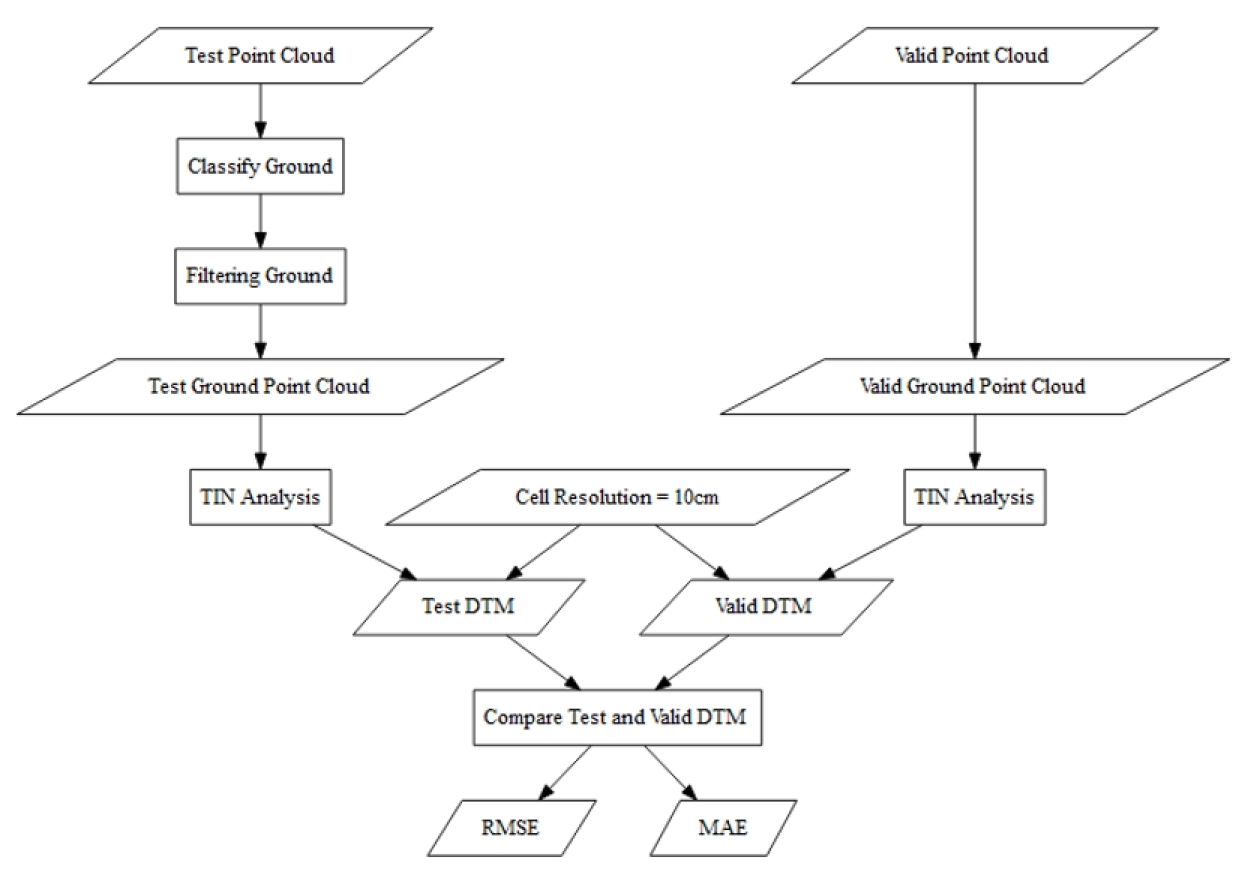

본 연구에서는 지형의 정량적 비교를 위해 점군 자료를 TIN (Triangulated irregular network) 알고리즘을 이용하여 DTM (Digital Terrain Model)으로 변환하였으며 DTM의 해상도는 10 cm로 설정하였다. DTM 변환 결과는 Fig. 5 및 Fig. 6과 같다. 식생처리 기법은 CIVE, ExG, ExGR, ExR, MExG, NGRDI, VEG, VVI, ATIN, ISL 등 10개 기법을 적용하였다. 8가지 색상필터는 R을 이용하여 구현하였으며 ATIN은 LAStools에서 제공하는 필터링 실행 파일 lasground_ new.exe을 이용하여 적용하였고 ISL은 R을 이용해 직접 구현하였다. 이때 가중함수의 매개변수 중 g와 w는 각각 0과 1로 고정하였다. Fig. 7에 제시한 절차에 따라 검증용 점군을 기반으로 생성한 DTM과 시험용 점군에 대해 10가지 기법으로 Ground Filtering을 수행해 생성한 DTM에 대한 비교를 수행하였다. 비교 결과는 RMSE (Root Mean Square Error)와 MAE (Mean Absolute Error)로 요약하였다.

4. 결과 및 고찰

4.1 식생 필터링 결과

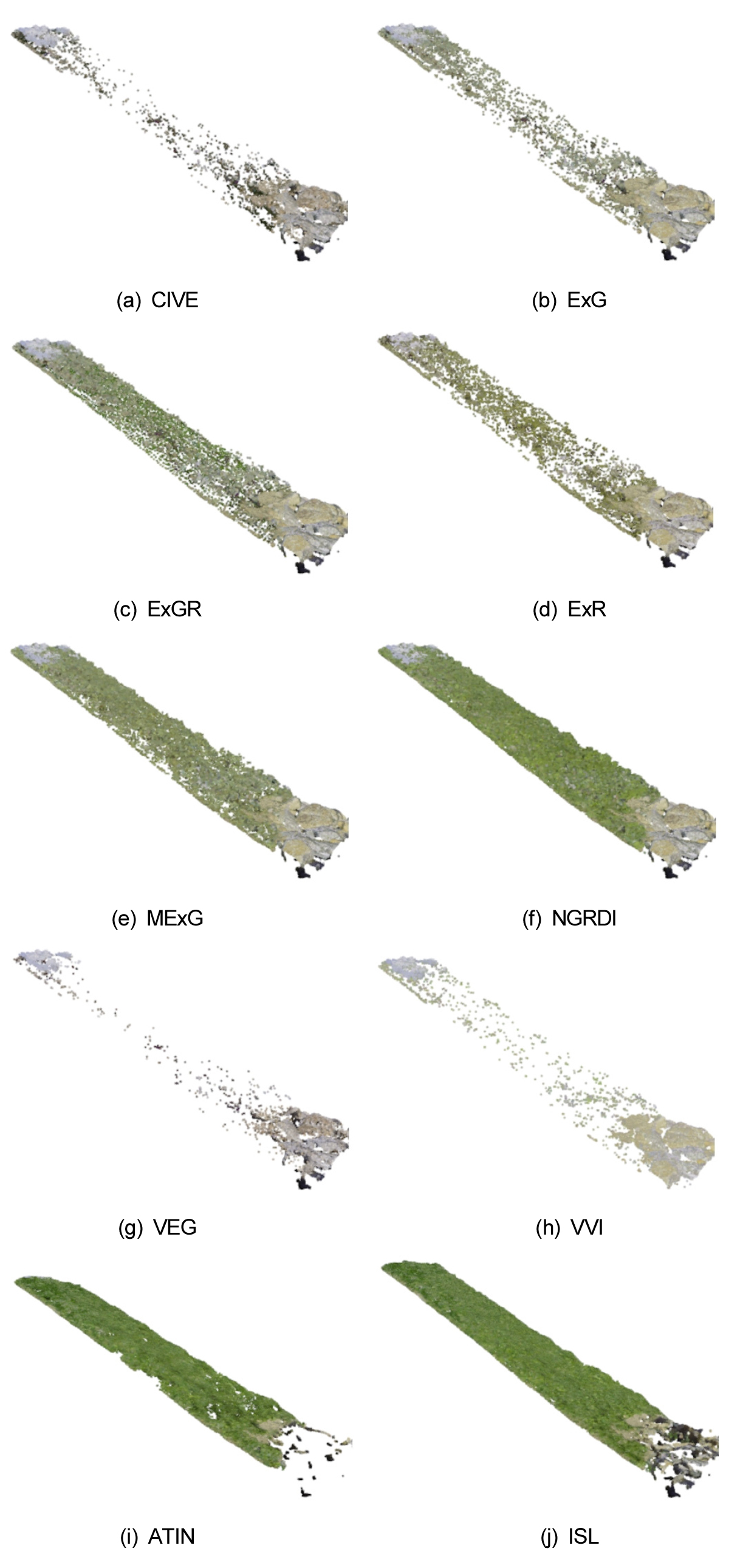

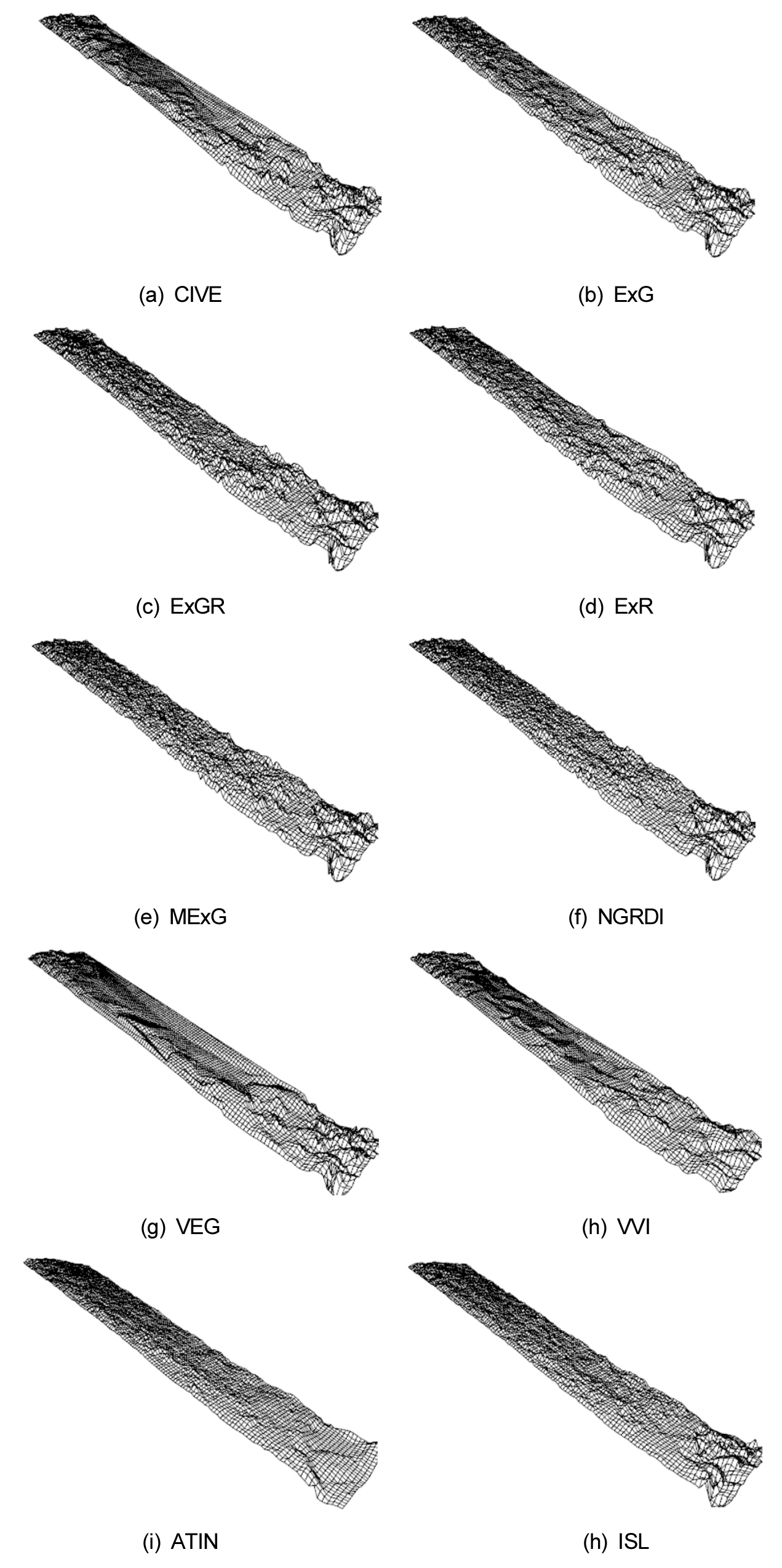

임진강 시험구간의 2020년 5월 영상 클라우드 포인트에 10가지 식생 제거 필터링을 적용한 결과는 Fig. 8과 같다. 각 기법에 따라 식생 영역으로 인식하여 제거한 결과는 다소 큰 차이를 나타낸다. CIVE, VEG, VVI 등은 하부 및 상부의 풀꽃과 거석을 제외한 중앙부의 대부분 영역을 식생 영역으로 인식하여 제거하였다. ExG와 ExR은 CIVE, VEG, VVI 등에 비해 중앙부에서 지반으로 인식하여 영역이 다소 넓어졌으며 ExGR과 Mex는 중앙부의 상당부분을 식생과 지반으로 구분하여 인식하는 경향을 보이고 있다. NGRDI는 중앙부의 대부분 포인트를 지반으로 구분하였다. ATIN과 ISL은 사면의 대부분 영역에서 지반을 잘 표현하고 있으나 하부 거석을 과도하게 제거하는 경향을 나타냈다. 특히 ATIN은 대부분의 거석을 식생으로 인식하여 제거하였다. 식생으로 구분하는 포인트가 많은 기법은 VEG, VVI, CIVE, ExG, ExR, ExGR, ExR, MExG, NGRDI, ATIN, ISL 등의 순으로 나타났다.

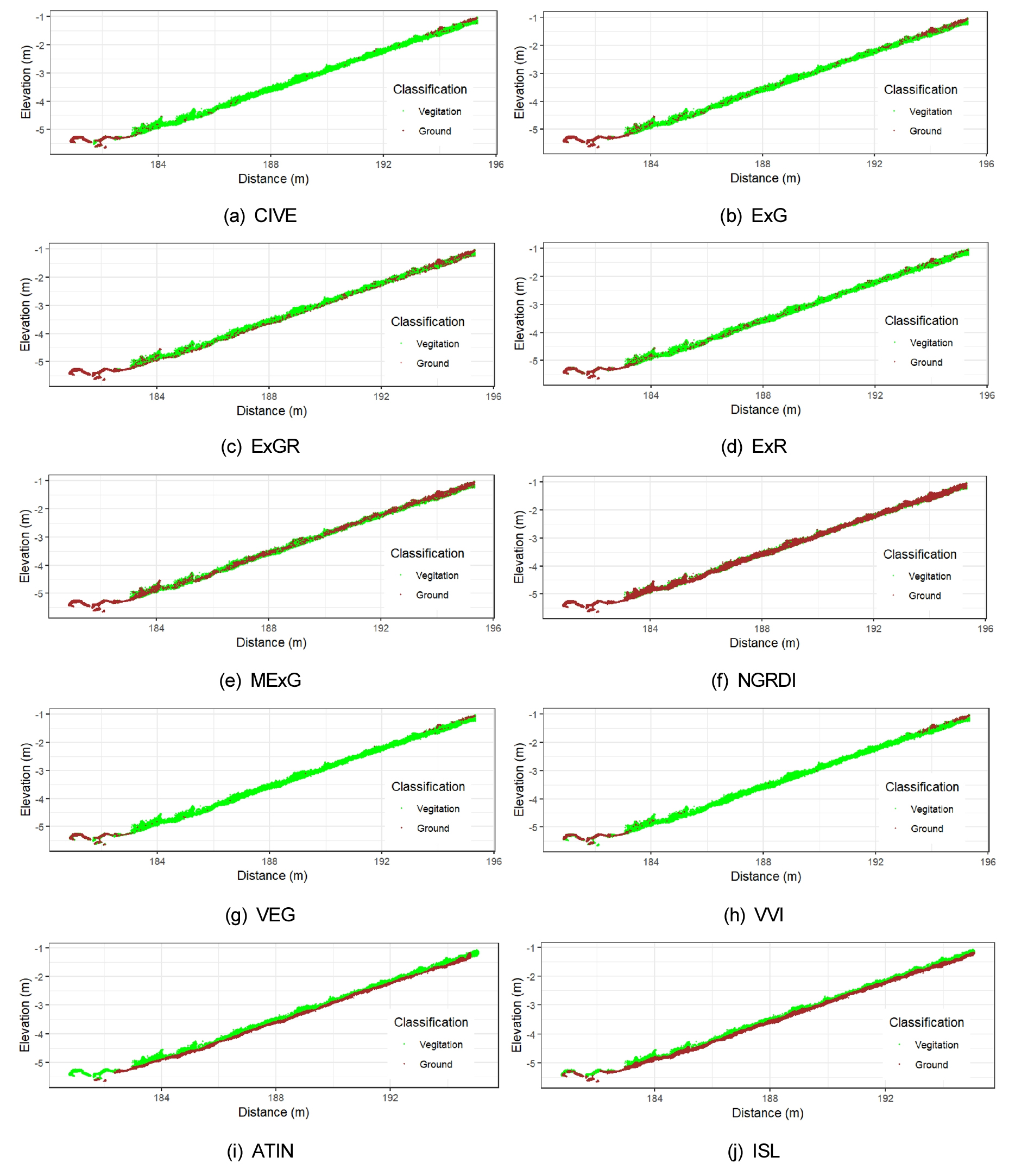

각 기법별로 식생 및 지반으로 구분한 포인트를 횡단면 상에서 표시하면 Fig. 9와 같다. CIVE는 지반에서 식생 높이에 이르는 대부분의 구간을 식생으로 구분하고 있다. ExG는 CIVE에 비해서는 지반을 구분하는 비율이 다소 높은 것을 볼 수 있으나, 식생 영역 중간 중간에 지반 포인트가 나타나는 것을 확인할 수 있다. ExGR은 식생 영역의 하단부에 지반 영역이 나타나 비교적 안정적으로 지형을 추정하는 것으로 보인다. ExR의 경우에는 ExG와 유사한 구분을 보이나 ExG에 비해서 다소 많은 지반 포인트를 나타낸다. MExG는 식생 포인트보다 지반 포인트가 많이 나타나며 식생 영역의 중앙에 지반 포인트가 두껍게 형성되어 있다. NGRDI는 대부분의 포인트를 지반으로 구분하고 있으며 VEG와 VVI는 대부분의 포인트를 식생으로 구분하고 있다. ATIN과 ISL은 하단의 거석을 제외한 사면에서 지반과 식생을 잘 구분하여 식생 하부에 지반이 뚜렷하게 나타나고 있다. 특히 ATIN은 구분하는 지반의 두께가 ISL 보다 작아 보다 정밀하게 지반을 나타내는 것으로 판단된다. 다만 ATIN과 ISL은 하단의 거석 영역도 식생으로 인식하여 제거하는 것을 다시 확인할 수 있다.

4.2 식생 필터링 결과와 원지반 비교

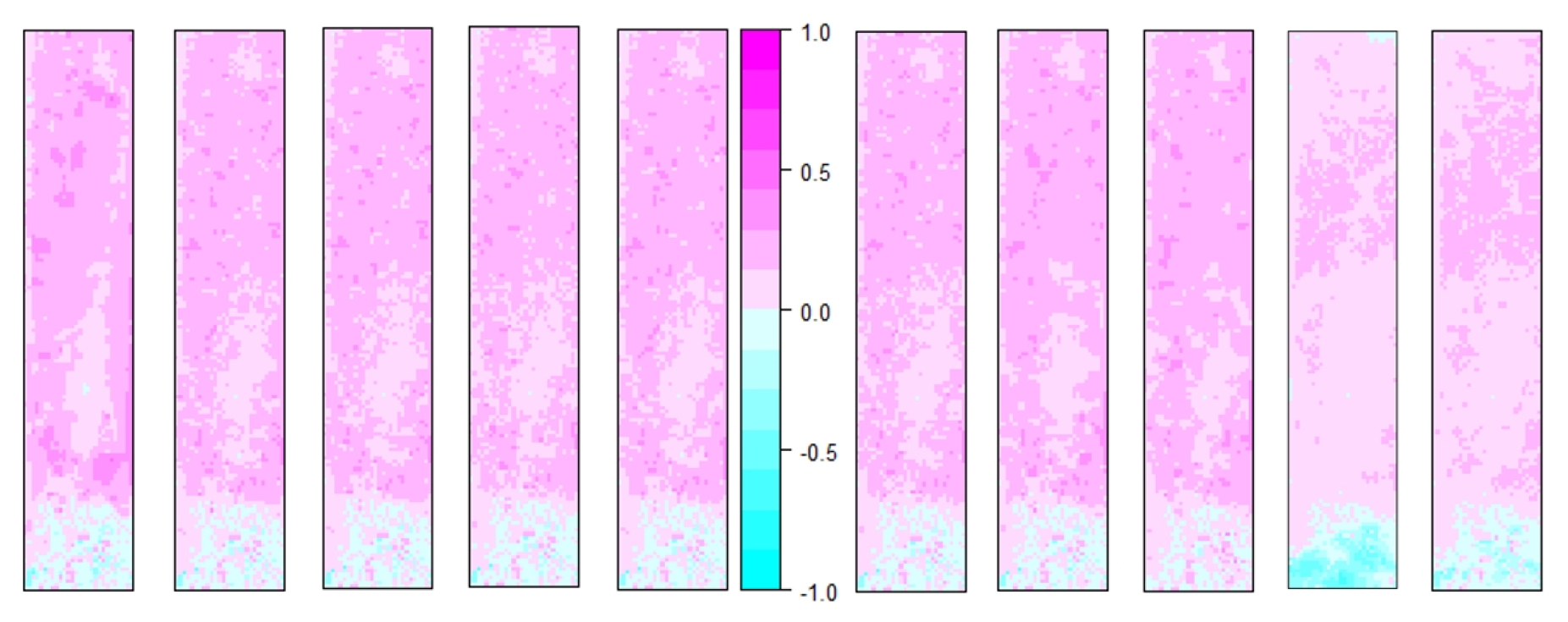

각 기법별 식생 필터링 결과를 Fig. 10과 같이 DTM으로 변환하여 2020년 3월 측량결과의 DTM과 비교하여 차이를 분석하였다. 각 기법별 식생 필터링 결과와 지반 표면의 표고 차이는 Fig. 11과 같다. Fig. 11에서 양의 값은 필터링 결과가 원지반보다 높음을 나타낸다.

10 가지 기법의 결과는 전체적으로 사면부에서는 식생이 충분히 제거되지 않아 원지반보다 높은 값을 나타내며 하단의 거석에서는 원지반보다 낮은 값을 나타낸다.

CIVE와 ExG는 유사한 결과를 나타내는데 사면 중앙 하단부 일부에서는 0.1 m 이하의 편차를 보이나 나머지 영역에서는 0.1 m 이상의 편차를 나타낸다. CIVE와 ExG는 식생 포인트를 과도하게 인식하여 원지반보다 지반 표고를 과소하게 추정하는 경향을 보인다. ExGR은 대부분의 영역에서 0.1 m 이하의 편차를 보이며 일부 영역에서 지반 표고를 다소 과소추정하는 경향을 보인다. ExR, MExG, NGRDI 등은 CIVE와 ExG에 비해서 중앙 하부에서 0.1 m 이하의 편차를 나타내는 영역이 다소 넓으며 나머지 대부분의 영역에서 0.1 – 0.3 m의 편차를 나타낸다. VEG는 중앙 하부 일부 영역에서 0.1 m 이하의 편차를 나타내나 우측 영역의 상당 부분에서 과도한 식생 제거에 따라 0.5 m 이상의 큰 편차를 보인다. VVI의 경우에는 중앙 하부의 0.1 m 이하의 편차를 나타내는 영역이 좁으며 대부분의 영역에서 0.1 m 이상의 큰 편차를 나타낸다. 반면에 ATIN과 ISL은 상단의 일부를 제외하고 사면부에서는 0.1 m 이하의 편차를 나타내어 상대적으로 식생 제거 정확도 높게 나타난다. 다만, 하단 거석은 나머지 8 개 기법에 비해 과도하게 제거하는 경향을 보인다.

각 필터링 기법별 전체 영역에서의 오차 비교 및 계산 시간은 Table 1과 같다. 오차가 작은 순서는 ISL, ATIN, ExR, NGRDI, ExGR, ExG, MExG, VVI, VEG, CIVE 등의 순서이다. 적용한 필터링 기법 중 오차가 가장 작은 ISL은 RMSE가 0.122 m이며, 오차가 가장 큰 기법은 CIVE로 RMSE는 0.195 m이다.

8가지 색상필터 기법의 편차는 0.167 - 0.195 m로 2가지 형태필터의 편차 0.122 m와 0.142 m에 비해서 확연하게 높게 나타났다. 색상필터 중에서는 ExR과 NGRDI가 상대적으로 정확하며 ExGR, ExG, MExG, VVI, VEG 등은 유사한 편차를 보인다. 반면에 CIVE는 0.195 m로 높은 편차를 보인다. 형태필터인 ATIN과 ISL은 색상필터에 비해 확연히 낮은 편차를 나타내는데 다만, 식생이 아닌 거석을 구분하지 못해 색상필터에 비해 거석 지점에서 큰 편차를 보인다. 계산 시간은 색상필터는 모두 1초 이하이나 형태필터는 11초 이상으로 10 배 이상의 차이를 보인다.

Table 1.

Error and computation time of filters of the vegetation images.

5. 결 론

본 연구에서는 식생이 무성한 제방의 이상유무 점검을 위해 지상 LiDAR 측량의 적용성을 평가하기 위하여 지상 LiDAR 측량으로 생성된 제방 사면의 영상 점군 자료에 식생 필터링 기법을 적용하여 각 기법별 정확성을 비교하여 적용성을 평가하였다. 대표적인 8가지 색상필터와 2가지 형태필터를 적용하였으며 적용결과는 각 기법별로 특성이 상이함을 확인하였다. 전체적인 정확성은 ISL, ATIN, ExR, NGRDI, ExGR, ExG, MExG, VVI, VEG, CIVE 등의 순서로 나타나 형태필터가 색상필터에 비해 정확도가 우수함을 확인하였다. 색상필터 중 CIVE, VEG, VVI 등은 식생 하부의 지반의 거의 구분하지 못하였으며, ExG과 ExR은 식생 내에서 지반을 구분하나, 식생 높이의 중간 정도에서 지반을 구분하는 특성을 보였다. ExGR는 지반을 비교적 잘 구분하나 전체적인 오차는 높게 나타났다. MExG와 NGRDI는 지반 영역을 과도하게 구분하는 특성을 나타냈다. 형태필터인 ISL과 ATIN은 식생 영역 하부의 지반을 잘 구분하며 오차도 적어 우수한 기법으로 평가되나 거석을 식생으로 인식하는 한계를 나타냈다. 색상필터는 풀꽃을 지반으로 인식하는 한계를 나타냈다.

연구 대상 필터 중 가장 정확도가 높은 ISL도 RMSE가 0.122 m로 높은 편이어서 제방 모니터링의 실무적인 측면에서 적용성은 아직은 한계가 있어 보인다. 식생 제거 필터의 정확성을 높이기 위해서는 형태필터 기반으로 색상필터 기법을 적용하여 형태필터에서 식생으로 인식하는 거석 등을 제대로 구분할 필요가 있다. 이를 위해서 향후에는 형태필터와 색상필터를 결합한 복합형 필터에 대한 연구를 수행할 필요가 있다.