1. 서 론

2. 연구 방법

2.1 기존의 드론영상 분석 방법

2.2 드론영상의 절대위치 찾기

2.3 측정소단면별 시공간영상 만들기

2.4 이용하는 드론과 카메라

2.5 프로그램의 작성

3. 결과 및 고찰

3.1 시험용 동영상 촬영

3.2 분석결과

4. 결 론

1. 서 론

하천의 유량은 수자원 계획과 하천방재를 위한 기초적이며 핵심적인 자료이다. 따라서, 홍수시와 갈수시에 상관없이 유량측정은 항상 시행되어야 하지만, 여러 가지 사정으로 홍수시 유량측정은 상당히 어려운 작업이다. 현재 국내의 유량측정기법은 유속계와 부자를 이용한 기법에 의존해왔다. 유속계를 이용한 유량측정기법은 고가의 장비가 필요하며 인력이 많이 필요하다는 단점이 있고, 부자를 이용한 유량측정기법은 측정자의 주관 및 측정 환경에 따른 오차 때문에 정확도가 높지 않다는 단점이 있다. 이에 대한 대안으로 최근에는 하천 영상을 이용한 표면영상유속계로 하천의 유량을 측정하는 연구가 활발히 진행 중이다

표면영상유속계를 이용한 유량 측정은 영상을 이용하기 때문에 카메라 외에 고가의 장비나 인력이 필요 없어 경제적이고 안전하며 넓은 범위의 유속을 순간적으로 측정할 수 있다는 장점이 있다 (Fujita 2013). 최근에는 넓은 범위의 하천 영역을 촬영하여 유속 및 유량을 측정하기 위해 항공기나 드론 영상을 이용한 연구도 활발히 진행 중이다 (Yu and Hwang 2017). 특히 항공기에 비해 드론은 운용이 쉽고 시간과 공간에 대한 해상도가 높아 하천의 물리량을 측정하는데 적합하다. 또한 하천 구조물 주변이나 보 월류부 등 직접 유속을 측정하거나 카메라로 촬영하기 힘든 곳에서의 영상을 담기 쉽다는 점도 큰 강점이다. 게다가 드론 영상은 내장 소프트웨어와 짐벌이라는 하드웨어를 통해 원근에 대한 영상 왜곡이 작은 영상을 얻을 수 있다. 또한 열영상 카메라 등 드론에 장착 가능한 다양한 센서를 활용하면 야간에도 영상을 촬영할 수 있어 드론의 하천 유속 측정에 대한 잠재력이 높다고 할 수 있다.

그런데, 이러한 드론영상을 이용한 유속계측법들은 반드시 지상의 절대적인 위치를 알고 있는 지상표정점 (GCP, ground control point)을 필요로 한다는 피할 수 없는 단점이 하나 있다. 이것은 지상표정점을 이용할 수 없는 대하천의 유속을 측정하는 데 드론을 이용하기 어렵다는 문제가 있다. 물론 드론의 고도를 높이면 어느 정도는 해결할 수는 있으나, 이 경우 영상의 해상도가 떨어져 유속의 정확도가 저하될 우려가 있다.

본 연구는 지상표정점을 찾을 수 없는 대하천에서도 동영상에 저장된 드론의 위치정보만으로 영상내 측정점의 물리적인 위치 (전역좌표)를 알아내는 기법을 개발하는 것이다.

2. 연구 방법

2.1 기존의 드론영상 분석 방법

굳이 드론영상이 아니더라도 항공영상을 이용하여 유속을 측정하고자 하는 시도는 상당히 일찍부터 시작되었다. 일본에서는 이미 1967년에 Kinoshita (1967)가 홍수시 하천 표면을 촬영한 2매의 항공사진을 카메론 효과 (입체시)를 이용하여 표면유속을 산정한 것이 그 효시라 볼 수 있다. 그 뒤 다양한 연구가 진행되었으나 본 연구와 직접적인 관련이 있는 헬리콥터나 드론을 이용한 연구로는 Takehara et al. (2002), Kunida et al. (2009)를 들 수 있다. 이들의 연구에서 영상의 흔들림은 지상의 표정점을 이용하여 보정하였다고 기술되어 있으나, 실제로 어떤 방법을 이용하였는지는 명시되어 있지 않다. 본격적으로 드론을 이용한 연구는 Notoya et al. (2016)의 연구라 볼 수 있다. 이 시기는 드론이 본격적으로 수자원연구에 활용되기 시작하는 무렵이다. 이들의 연구에서는 처음으로, 지상표정점을 추적하는 데 SIFT나 RIPOC, RANSAC 알고리즘을 조합하였다고 기술되어 있다. 일본 이외에서는 Tauro et al. (2016)과 Bolognesi et al. (2016) 등의 연구가 드론을 이용한 표면유속 측정을 시도하였으나, 이들 문헌에서는 영상 처리에 대한 세부적인 내용을 밝히지 않았다. 국내에서는 Yu and Hwang (2017)의 연구나 Liu (2021), Lee et al. (2021)의 연구를 들 수 있다. 그 외에 영미권에서 다양한 드론영상유속계에 대한 연구가 되었으나, 원래 표면영상유속계측에 대한 연구가 일본에서 시작된 것을 생각하면, 영상분석에 있어 영미권의 연구는 특별히 주목할 만한 내용이 없어 더 이상 언급하지 않는다. 이런 연구의 대부분은 얼마나 효율적으로 지상표정점을 찾고 이를 이용하여 영상을 보정할 것인가에 초점이 맞추어져 있다.

본 연구의 핵심 주제인 지상표정점이 없이 영상의 물리좌표를 구하는 방법은 Liu (2021)이 드론의 비행기록에서 찾아내어 적용하고 시도하였으나, 드론의 비행기록을 일일이 찾아내서 변환해야 하며, 실제로 많은 이용자들이 그런 것이 있다는 점조차 모른다는 것을 생각하면 효용성이 높지 않을 것으로 보인다. Lee et al. (2021)도 드론 카메라 렌즈의 축척만을 이용하는 방법을 제시하였으나, 이 또한 영상내 특정 위치의 물리좌표를 정확히 찾기는 곤란하였다.

2.2 드론영상의 절대위치 찾기

주어진 드론영상에서 영상의 물리적 위치를 찾기 위해서는 추가적인 정보가 반드시 필요하다. 기존의 드론을 이용한 표면유속측정 연구에서는 지상표정점에 의존하였다. 즉, 지상표정점을 이용하여 동영상의 보정이나 영상변위를 물리변위로 환산하기 때문에, 지상표정점의 존재는 필수적이었다. 그러나, 대하천과 같이 폭이 넓은 하천에서는 적절한 수의 지상표정점을 확보할 수 없다. 따라서, 본 연구에서는 먼저 지상표정점없이 드론영상에서 물리위치를 결정하는 방법을 만들었다.

대부분의 드론의 경우 비행정보를 드론의 제어프로그램이나 드론 자체에 로그 파일 형태로 기록하며, 일부 드론의 경우 동영상에 직접 드론의 위치정보 (GPS)를 표시하기도 한다. 본 연구에서는 이 영상에 표시된 GPS 정보를 이용하여 영상의 절대위치를 결정하기로 하였다. 그런데, 이 정보에는 영상의 중심 위치를 알려주지만, 영상의 다른 부분이 어디에 해당하는지는 알 수 없다. 그래서, 먼저 이 드론의 GPS 정보를 이용하여 영상의 절대위치를 찾는 방법을 고안하였다.

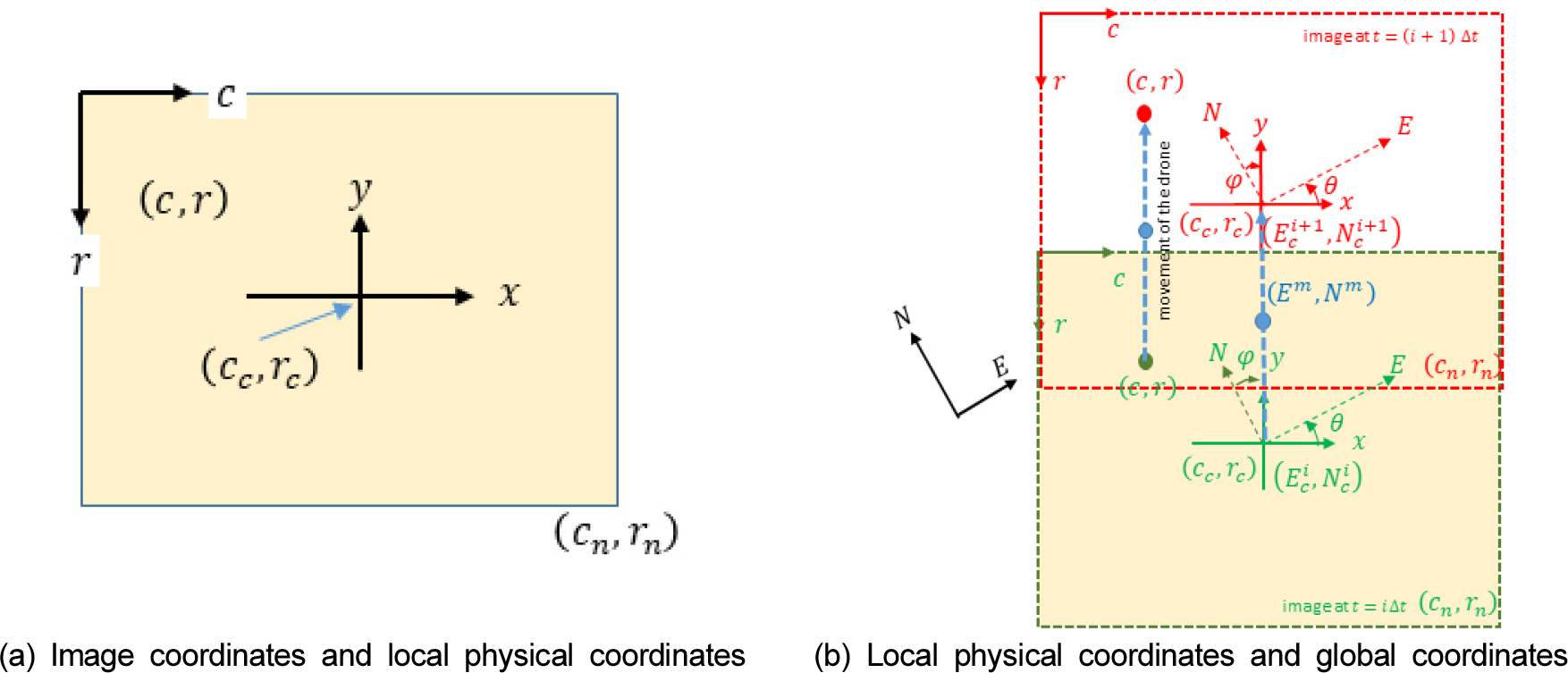

먼저 영상좌표 과 영상의 중심에 대한 국소물리좌표 사이의 관계는 다음과 같이 주어진다 (Fig. 1 (a) 참조).

여기서 는 국소좌표 (단위 (m, m))이고, 는 영상좌표를 국소물리좌표로 바꾸는 변환계수 (m/pixel)로 축척의 역수이며, 는 영상의 중심좌표 (단위 (화소,화소))이다.

이 때 변환계수 는 본 연구에서 사용한 카메라(Zenmuse H20T)의 경우, 다음과 같이 나타낼 수 있다 (Lee et al. 2021).

여기서 는 수면에서 카메라까지의 연직높이 (m)이다.

Eq. 1에서 영상 좌표에서 국소좌표로의 역변환은 다음과 같다.

여기서 는 (화소,화소) 단위의 영상좌표계이다.

이번에는 국소좌표 와 전역좌표 의 관계를 살펴보자. 이를 위해서는 드론의 영상의 방향 (영상의 윗부분이 향하는 방향이며, 이를 ‘영상방향’이라 부르기로 한다)을 알아야 한다. 이 영상방향은 드론의 이동방향이나 방위각 (진북과 이루는 시계방향각이며, -180° - 180° 또는 0° - 360°의 값을 갖는다) 등에서 알아내야 한다. 일단 이 영상방향을 라고 하자. 방위각은 180° - 180° 또는 0° - 360°의 값을 가지며, 여기서는 시계방향으로 0° - 360°의 값을 이용한다.

Fig. 1 (b)에서 번째 영상의 국소좌표 를 방위각 만큼 반시계방향으로 회전시킨 뒤 번째 영상의 영상중심에 대응하는 전역좌표 위로 이동시키면 국소좌표를 전역좌표로 바꿀 수 있다. 따라서, 변환식은 다음과 같다.

반대로 Eq. 4에서 전역좌표를 국소좌표로 변환하는 역변환은 다음과 같다.

따라서, Eq. 5와 Eq. 3을 이용하면, 전역좌표에서 영상좌표로의 변환을 나타낼 수 있으며, 반면 Eq. 1과 Eq. 4를 이용하면 영상좌표에서 전역좌표로의 변환을 각각 나타낼 수 있다.

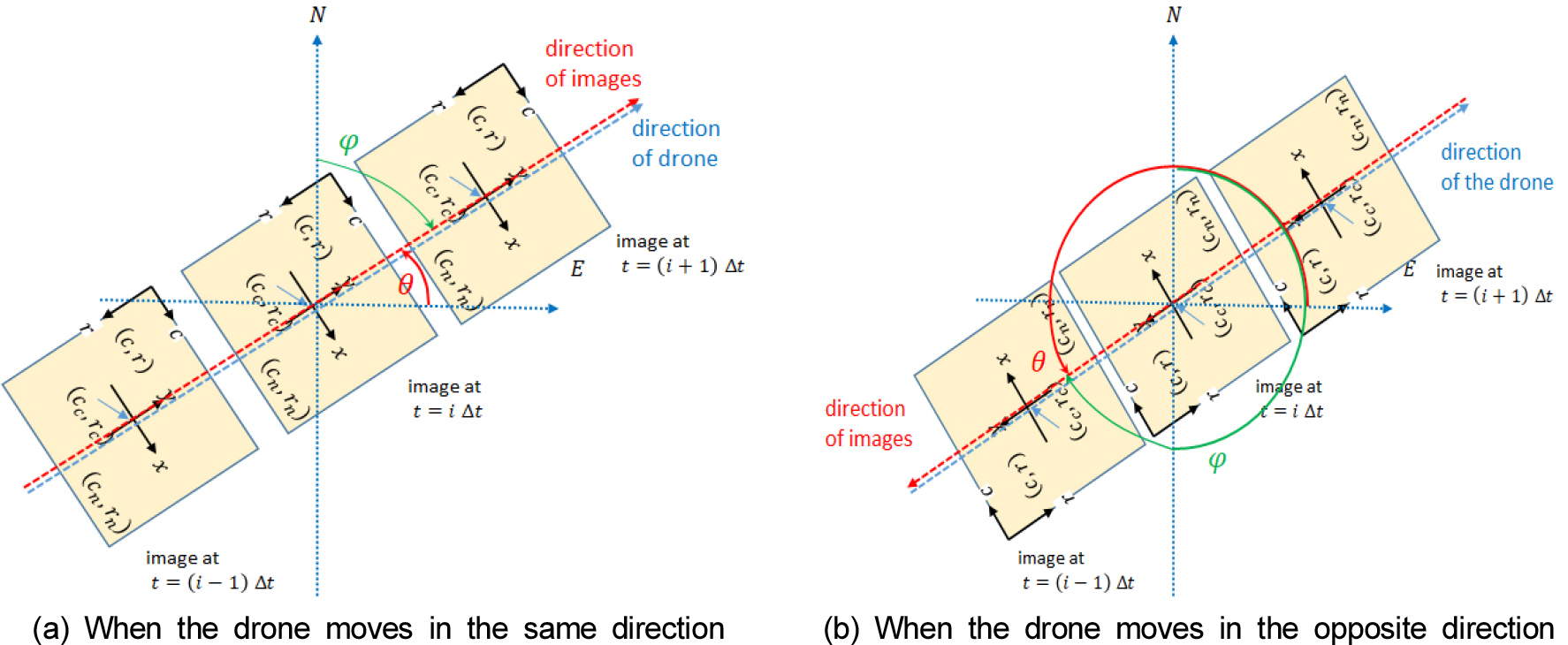

위의 변환관계에서 반드시 알아야 하는 것이 영상방향 이다. 영상방향은 이동하는 드론의 동영상에 기록된 GPS 정보에서 구할 수 있다. 다만, 이 때 한 가지 중요한 가정을 해야 한다. 즉, 드론은 영상방향 ( 축) 또는 아랫방향 (축)으로만 일정 속도로 이동한다. 그리고 영상방향은 진북방향과 이루는 방위각 (진북과 이루는 시계방향각이며, -180° - 180° 또는 0° - 360°의 값을 갖는다) 으로 나타내기로 한다. 그런데, 영상방향을 직접 구하기는 어려우며, 드론의 이동방향 (동쪽에 대한 반시계방향 각)를 이용해서 구해야 한다. 즉 0번째 영상 (시작프레임)의 중심의 물리좌표 와 번째 영상 (종료프레임)중심의 물리좌표 는 영상에 기록된 GPS 정보에서 드론의 진행방향 를 구할 수 있다.

여기서 는 0번째 영상 (시작프레임)의 중심의 물리좌표, 는 번째 영상 (종료프레임)중심의 물리좌표를 각각 나타낸다.

이 관계는 Fig. 2에 자세히 제시되어 있다. 그리고, 영상방향 와 드론의 이동방향 는 의 관계를 갖는다.

2.3 측정소단면별 시공간영상 만들기

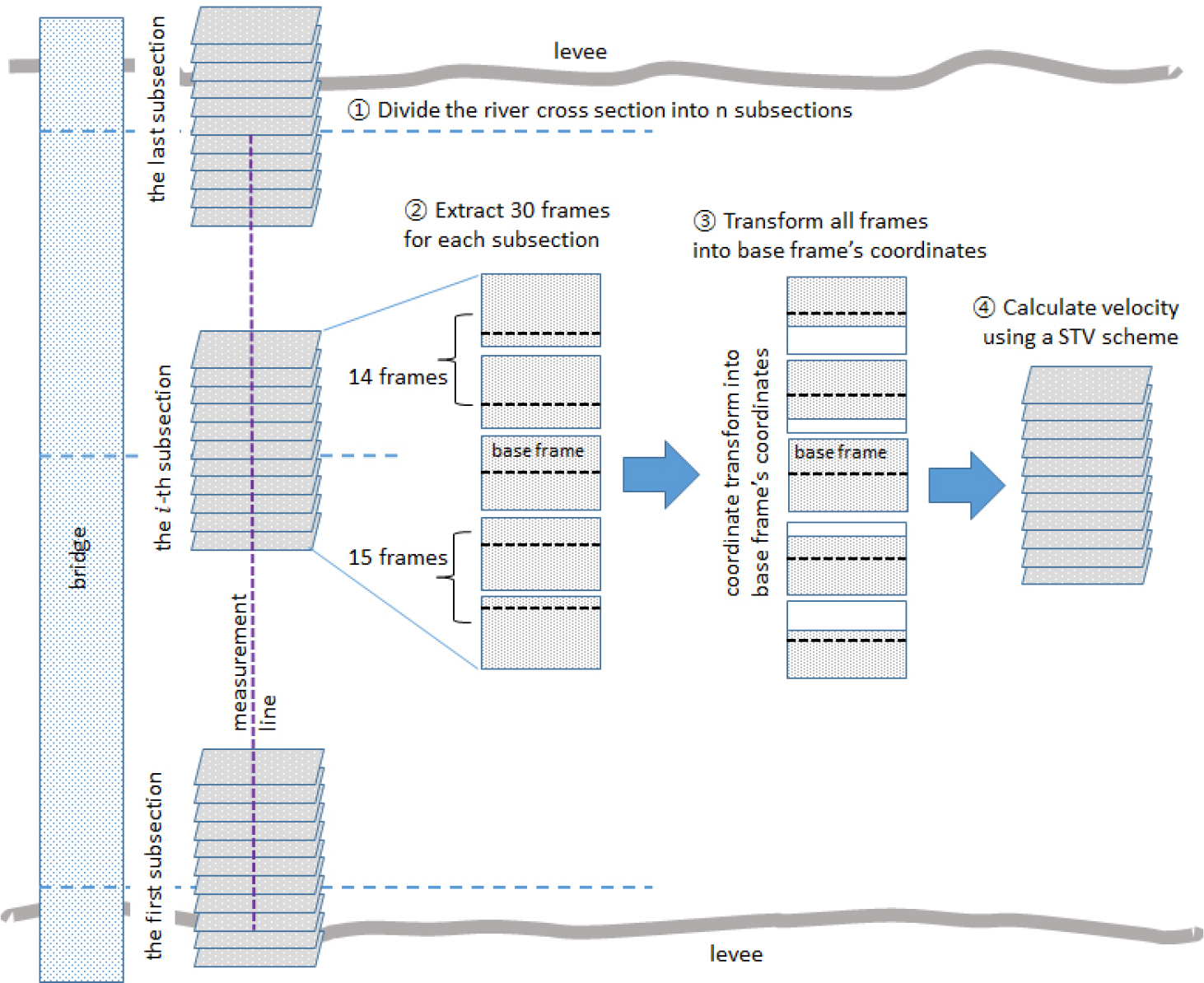

측정소단면별 시공간영상을 만들고 여기서 유속을 분석하는 방법과 과정은 Fig. 3과 같다. Fig. 3의 ①과 같이 측정소단면을 지정한다. 측정소단면을 지정하기 위해서는 먼저 동영상에서 분석을 시작할 시작프레임과 분석을 마칠 종료프레임을 지정한다. 그리고 그 사이에 이 두 프레임에서 읽어낸 GPS 정보에서 앞서 설명한 방법으로 각 프레임의 물리적 위치를 결정한다. 물리공간에서 일정 간격으로 설정된 측정소단면 (measurement subsection)에서 영상분석을 한다. 이 때 측정소단면이 포함되는 프레임 수는 영상의 축척과 드론의 이동속도에 따라 달라지나, 시공간영상분석법으로 표면유속을 추정하기 위해서는 적어도 1초 (30매) 이상의 영상이 되게 해야 한다. (본 연구에서 시험해 본 결과 이 제약조건은 항상 충분히 만족하였다.) 따라서 번째 측정소단면이 정확히 (또는 가장 가깝게) 영상 중앙에 위치하는 프레임을 번째 기준프레임으로 잡고, 그 앞의 15매 영상과 기준프레임, 그리고 기준프레임 뒤의 14매 영상, 도합 30매의 영상을 한데 모아 분석을 하기로 한다 (Fig. 3 ②). 어떤 측정소단면에 대해 추출된 30매의 영상은 드론의 이동속도를 고려하여, 기준프레임과 영상의 가로중심선이 일치하도록 이동한다 (Fig. 3 ③). 그리고 이 가로중심선에 일정 간격의 격자를 형성하고 시공간영상분석을 하면 유속장을 구할 수 있다. 시공간체적을 이용한 영상분석법의 자세한 내용에 대해서는 Yu and Liu (2021)을 참조하기 바란다.

이 과정을 개요도로 보이면 Fig. 3과 같다.

2.4 이용하는 드론과 카메라

본 연구에서 적용한 장비는 DJI 사의 Matrice 300 RTK이며, 장착된 카메라는 Zenmuse H20T이다. 이 드론의 모습과 제원, 장착된 카메라의 제원은 Table 1과 같다.

Table 1.

Drone and camera used in the study

2.5 프로그램의 작성

드론표면영상유속계 프로그램은 Python으로 작성하였다. 이 때, GUI는 PyQt6 모듈, 영상처리는 OpenCV 모듈, 자료입출력은 Pandas 모듈, WGS84(World Geodetic Sytem 84)와 UTM의 좌표변환은 pyproj 모듈을 각각 이용하였다.

3. 결과 및 고찰

3.1 시험용 동영상 촬영

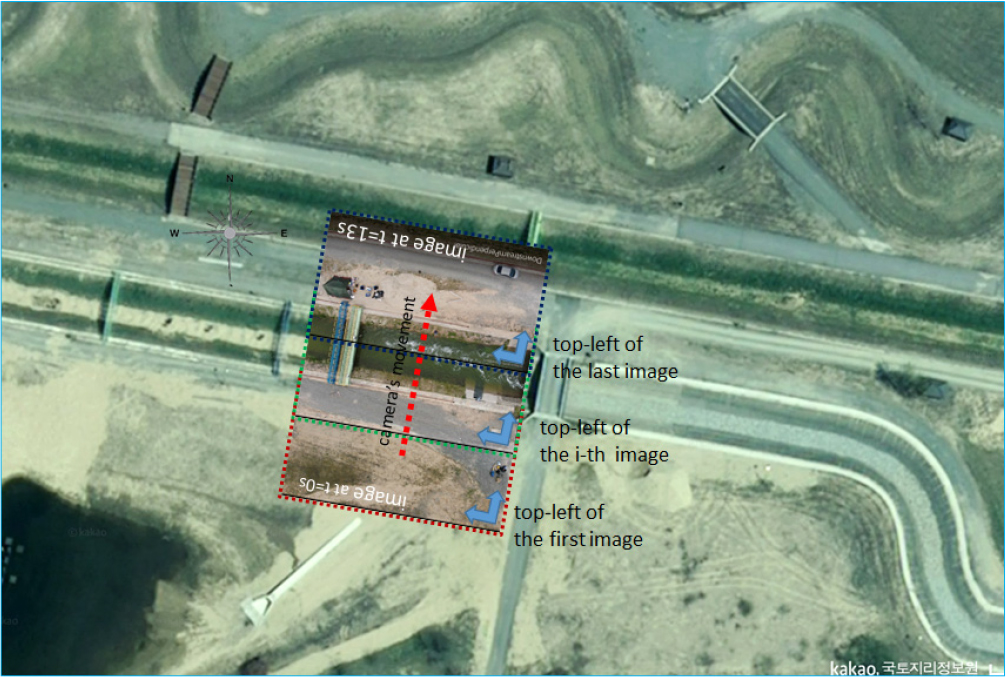

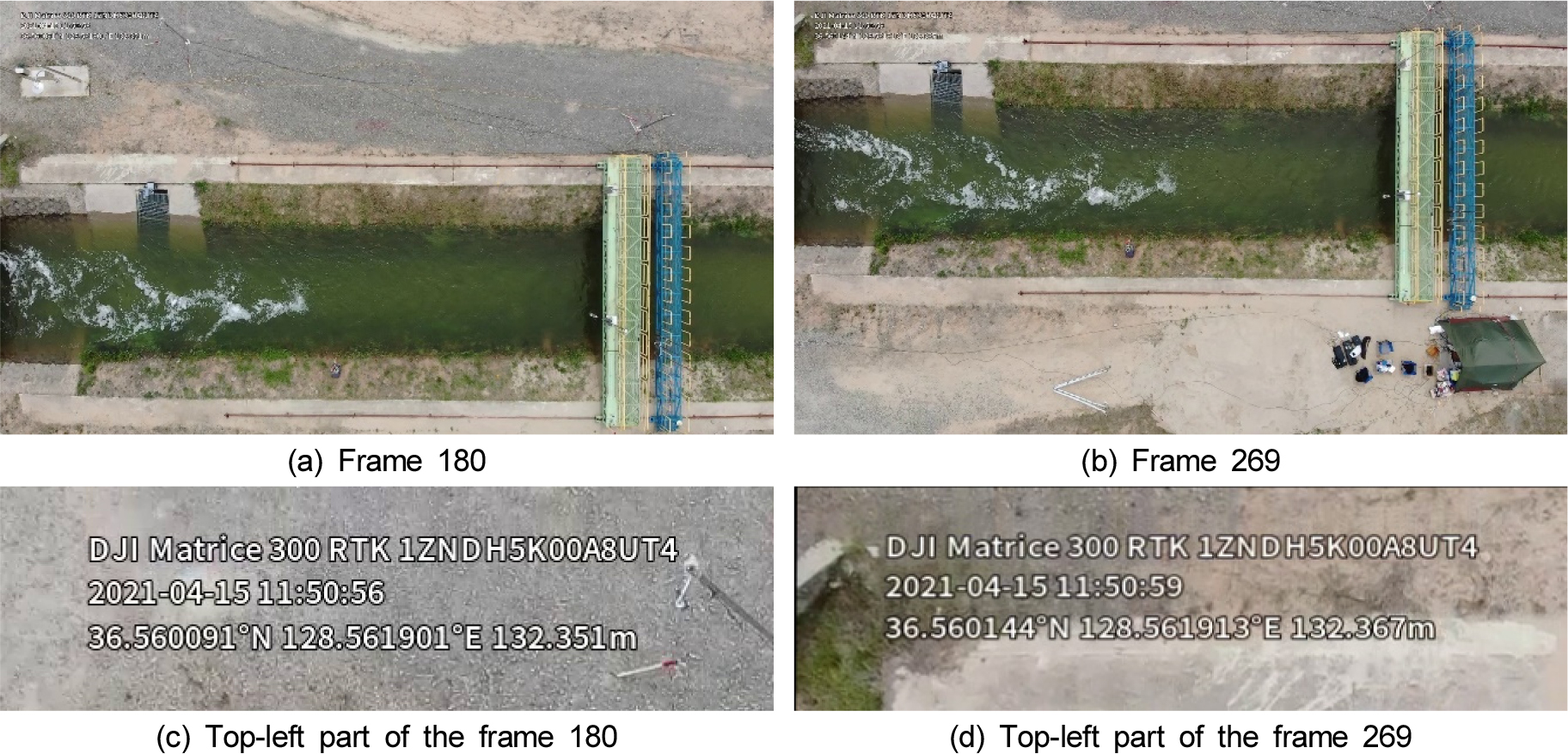

개발된 프로그램은 안동하천실험센터의 급경사수로에 적용하여 시험하였다. 시험은 이 프로그램의 개발 한참 이전인 2021년 4월 15일에 촬영한 동영상을 이용하였다. 시험현장과 드론의 이동방향은 Fig. 4에 보인다.

그리고, 이 동영상의 몇 프레임을 예로 보이면 Fig. 5와 같다. Fig. 5에서 알 수 있듯이, 이 드론에서 잡은 영상의 한 프레임 크기는 1,920×1,080 화소이며, 이 동영상의 왼쪽윗부분에는 드론의 위치 정보가 WGS84로 기록되어 있다. 이 때 GPS 정보의 기록빈도는 1/10초이다. 이 정보는 위도와 경도, 고도를 차례로 제시해 준다.

여기서 보면 왼쪽윗부분에 드론의 위치가 “(위도, 경도, 고도)”의 순으로 제시되어 있다. 그러나, 이 자료는 실제 계산에 적용하기는 어려우므로, UTM 좌표로 변환해야 한다. WGS84와 UTM의 좌표 변환에는 Python의 pyproj 모듈을 이용하였다. 변환조건은 “타원체: GRS80, 원점: 중부, 원점가산: 2009.12 이후”이며, WGS는 “epsg:4326”, UTM으로는 “epsg:5186”을 선택하였다.

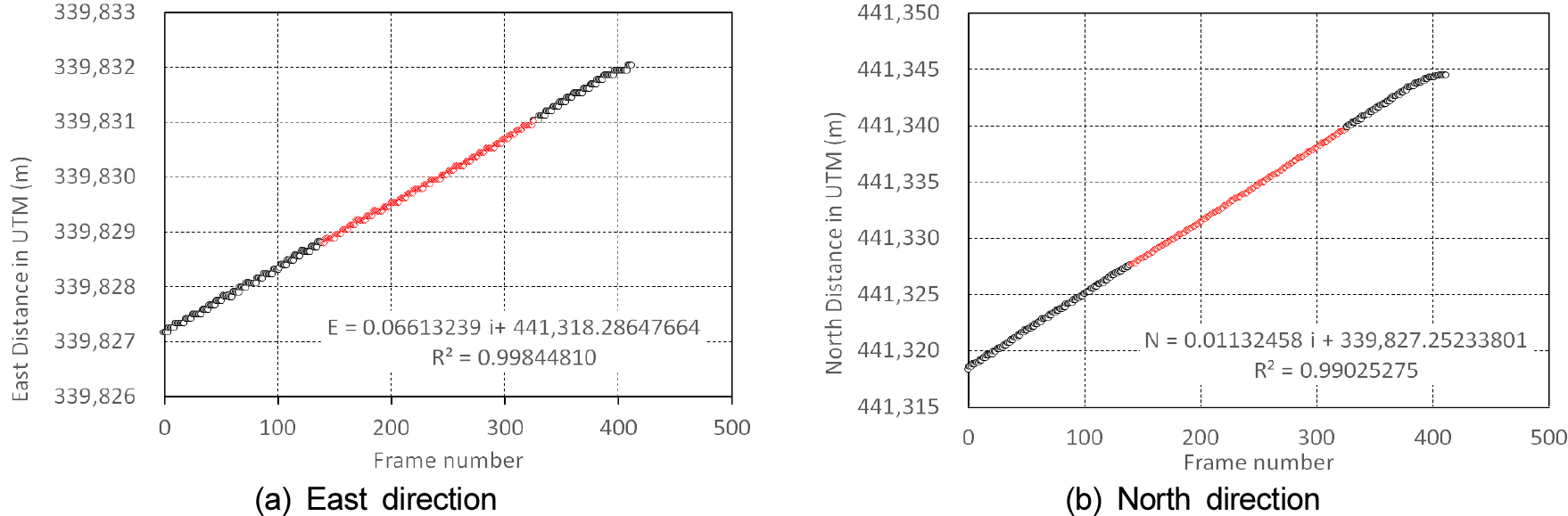

이 동영상에서 Python의 EasyOCR 모듈을 이용하여 영상내에 수록된 GPS 좌표를 취득하였다. 그 결과를 도시하면 Fig. 6과 같다. 다른 대부분의 DJI 드론과 마찬가지로 본 연구에서 사용한 Matrice 300 RTX는 드론의 GPS 정보를 1/10초마다 1회씩 측정하여 기록한다 (Liu 2020). 이것은 Fig. 6에서도 확실하게 알 수 있다. 또한, 동영상을 촬영할 때, 드론이 별 문제없이 주어진 경로를 직선으로 잘 운행했음을 알 수 있다. 이 때, 드론은 속도 1.96 m/s로 영상의 아랫방향으로 진행하며 촬영하였다.

다만, 첫부분과 마지막 부분은 진로를 변경한 부분이 있어 사용하기 곤란하므로, 중간 부분에 있는 프레임만을 이용한다. 또한, 기존의 드론영상을 이용한 표면영상유속계측에서 자주 이용하던, 고정점에 대한 보정기법을 이용한 결과와 비교하기 위해, 하천 표면의 고정점이 확실하게 나타나는 140번 프레임부터 325번 프레임까지 185매의 영상 (약 6초 분량)을 이용하여 분석을 하기로 한다. Fig. 2에서 제시한 방법으로 Fig. 5의 동영상을 살펴본 결과, 드론의 이동방향은 °, 영상방향 이었다.

이 때 사용한 격자는 가로방향으로 2.0 m 간격의 11개 격자, 세로방향으로 1.0 m 간격의 14개 격자를 이용하였다.

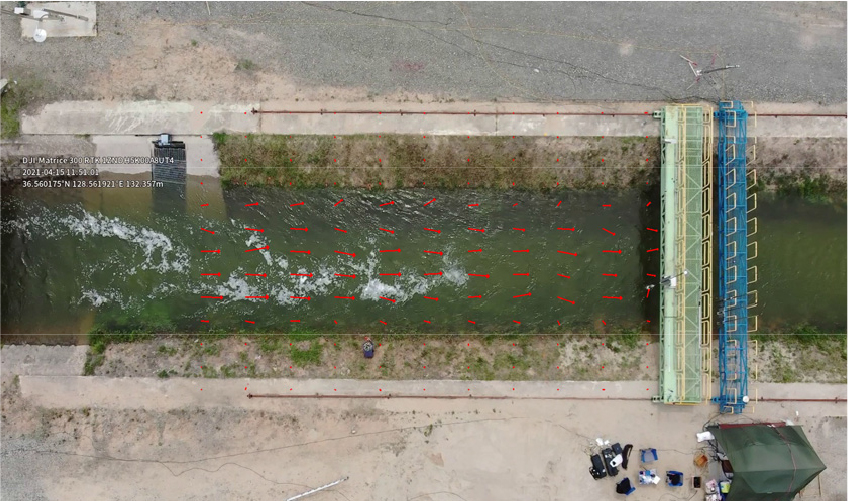

3.2 분석결과

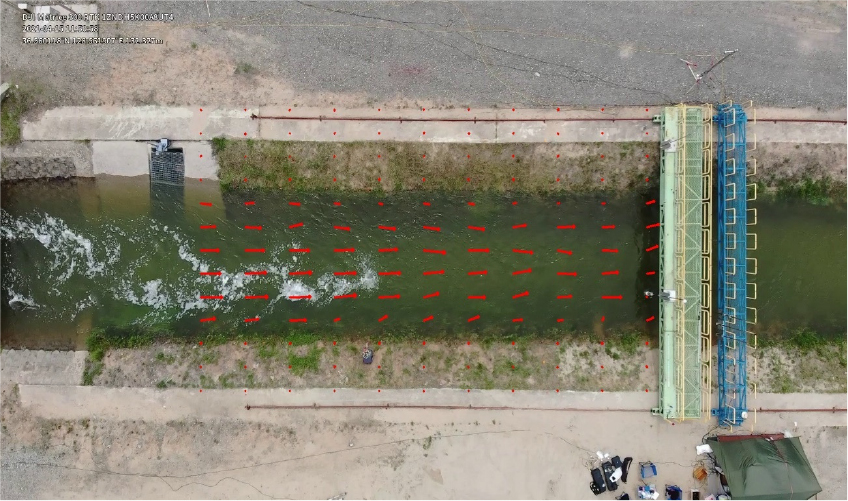

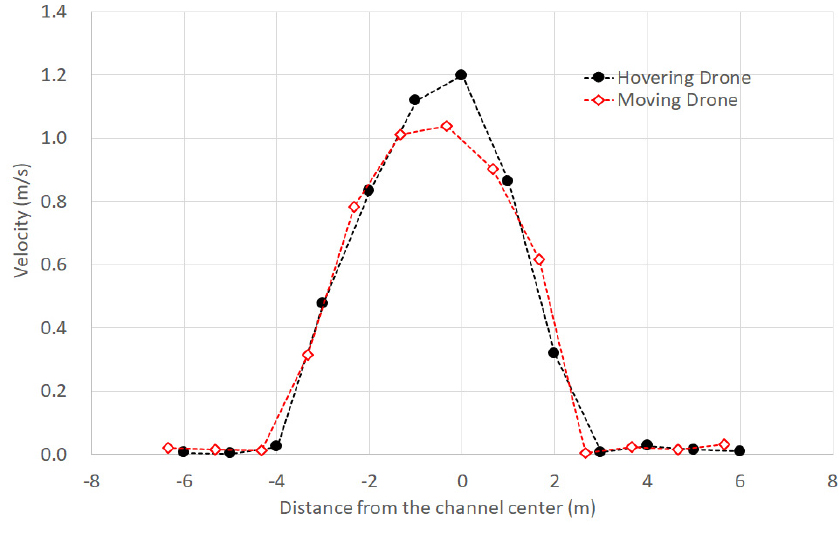

위의 방법을 이용하여 분석한 결과는 Fig. 7과 같다. 이 결과에서는 눈으로 확인하기는 어렵지만, 수면이 아닌 부분의 속도는 거의 정확하게 0에 가까운 값을 보이며, 수로 횡단면을 따라 적절한 유속 분포를 보인다. 또한 비교를 위해, 정지비행 드론 영상의 분석법 (지상표정점을 이용하여 모든 프레임을 기준 프레임으로 변환한 뒤 영상분석하는 방법)을 이용하여 같은 동영상을 처리한 결과를 Fig. 8에 보인다. 단, 이 정지드론법에서는 지상표정점으로 사용할 수 있는 4개의 지점을 공유하는 영상을 선정하기 위해, 180 프레임부터 269 프레임까지의 90개 프레임 (3초 영상)을 이용하였다.

수치적인 비교를 위해 영상의 중앙부분의 유속을 Table 2와 Fig. 9에 보인다. 두 방법의 차이 때문에 정확하게 같은 위치 (세로 방향으로 약 0.34 m 차이발생)에서 유속을 측정할 수 없었으며, 결과를 보일 때는 이를 같은 위치로 보정하여 제시하였다.

Table 2.

Comparison of velocity distribution measured by two methods

이 결과에서 보면, 약 가로 방향 유속 ()이 한 지점에서 최대 0.3 m/s 정도의 차이를 보이나, 다른 측정점들의 유속은 큰 오차를 보이지 않고 비교적 정확한 값을 보인다. 반면 세로방향 유속 ()은 몇 지점에서 다소 큰 변동을 보인다. 이것은 드론의 이동이나 약간의 흔들림 등에 기인한 것으로 보인다.

4. 결 론

지상표정점을 이용하지 않고도 동영상에 기록된 위치정보 (GPS 자료)만을 이용하여 드론으로 촬영한 동영상에서 절대위치의 유속을 산정할 수 있는 방법을 개발하였다. 이 방법을 요약하면 다음과 같다.

(1)드론 동영상에서 있는 GPS 정보를 이용하여 드론의 이동방향과 영상이 향하는 방향을 결정하는 방법을 제시하였다.

(2)영상방향을 결정한 뒤, 각 영상점을 물리적인 전역좌표계 (UTM 좌표계)로 변환하는 방법을 제시하였다.

(3)시작프레임과 종료프레임을 지정하고, 이를 일정간격의 기준프레임 (측정소단면)으로 나눈 뒤, 1초간 영상 (30 프레임)을 모아서 시공간체적분석법으로 유속을 분석한다.

(4)분석된 영상을 전체로 통합한 영상에 표시한다.

개발된 방법을 기존의 정지비행드론을 이용한 동영상분석법과 비교한 결과 상당히 양호한 결과를 보였다.